Local Deep Research: Tự xây dựng trợ lý nghiên cứu AI riêng tư, đạt chuẩn 95% SimpleQA ngay trên máy bạn

Tóm tắt nhanh:

- Local Deep Research (LDR) là trợ lý nghiên cứu AI mã nguồn mở, chạy hoàn toàn cục bộ, kết hợp nhiều LLM và search engine để tạo báo cáo có trích dẫn đầy đủ.

- Đây là dự án mã nguồn mở đầu tiên đạt khoảng 95.7% SimpleQA và 77% xbench-DeepSearch chỉ trên một GPU RTX 3090 với model Qwen3.6-27B.

- Hỗ trợ 20+ chiến lược nghiên cứu, nổi bật là LangGraph Agent cho phép LLM tự quyết định tìm kiếm trên arXiv, PubMed, Semantic Scholar và tổng hợp.

- Bảo mật cấp Signal: mỗi user có database SQLCipher mã hoá AES-256, không telemetry, không tracking, dữ liệu hoàn toàn nằm trên máy bạn.

- Cài đặt cực nhanh qua Docker Compose, pip hoặc Docker Run; chạy được trên Linux, macOS, Windows, WSL2 và Unraid.

Trong kỷ nguyên mà các dịch vụ “Deep Research” của OpenAI, Google hay Perplexity thu phí cao và đòi hỏi gửi dữ liệu lên cloud, Local Deep Research mang đến một lựa chọn hoàn toàn khác: bạn vẫn có một trợ lý nghiên cứu mạnh ngang ngửa, nhưng mọi thứ chạy ngay trên phần cứng của bạn.

Local Deep Research là gì

Local Deep Research (viết tắt là LDR) là một AI Research Assistant mã nguồn mở do cộng đồng LearningCircuit phát triển trên GitHub. Khác với các “Deep Research” thương mại, LDR cho phép bạn:

- Sử dụng bất kỳ LLM nào thông qua Ollama, LM Studio, llama.cpp hoặc endpoint tương thích OpenAI

- Chạy hoàn toàn local cho mục đích bảo mật tuyệt đối

- Tự xây dựng cơ sở tri thức có thể tìm kiếm được từ chính tài liệu cá nhân

- Toàn quyền sở hữu dữ liệu: không telemetry, không analytics, không phone-home

Điểm gây chú ý nhất của dự án là benchmark: với chiến lược langgraph-agent chạy trên model Qwen3.6-27B local, LDR đạt 95.7% SimpleQA (287/300) và 77% xbench-DeepSearch, một con số trước đây gần như chỉ thấy ở các hệ thống cloud lớn.

Vì sao LDR đáng để dùng

Toàn bộ quy trình nghiên cứu tự động

Bạn chỉ cần đặt một câu hỏi phức tạp. LDR sẽ tự động tìm kiếm trên web, các bài báo học thuật và cả tài liệu riêng của bạn, sau đó tổng hợp tất cả thành một báo cáo có trích dẫn đúng chuẩn. Người dùng có thể chọn giữa hơn 20 chiến lược nghiên cứu, từ quick facts đơn giản đến phân tích chuyên sâu hoặc nghiên cứu học thuật.

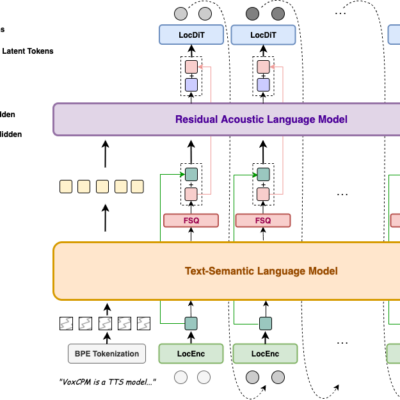

LangGraph Agent: Bộ não tự ra quyết định

Chế độ langgraph-agent là chế độ agentic thực sự: LLM tự quyết định nên tìm gì, dùng search engine chuyên dụng nào (arXiv, PubMed, Semantic Scholar, SearXNG…) và khi nào thì nên tổng hợp. Cách tiếp cận này thu thập nhiều nguồn hơn đáng kể so với pipeline tĩnh và chính là yếu tố giúp đạt độ chính xác cao trong benchmark.

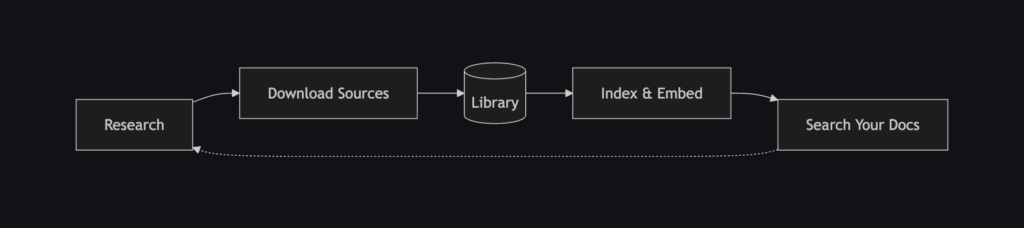

Knowledge Base cá nhân tích luỹ theo thời gian

Mỗi phiên nghiên cứu đều phát hiện ra tài liệu giá trị. LDR cho phép tải trực tiếp những tài liệu này vào thư viện mã hoá, trích xuất văn bản, index và embed để tìm kiếm. Lần nghiên cứu sau, bạn có thể hỏi đồng thời cả tài liệu riêng và web. Tri thức của bạn tăng dần theo thời gian.

Bảo mật ở cấp Signal

Mỗi user có một database SQLCipher mã hoá AES-256 riêng biệt. Không có cơ chế khôi phục mật khẩu, đồng nghĩa với việc đây là hệ thống zero-knowledge thật sự, ngay cả admin server cũng không thể đọc dữ liệu. Khi kết hợp với Ollama và SearXNG cục bộ, không một byte nào rời khỏi máy bạn.

Các chế độ nghiên cứu của LDR

LDR cung cấp 4 chế độ chính, mỗi chế độ phục vụ một loại nhu cầu khác nhau:

- Quick Summary: Câu trả lời nhanh có trích dẫn trong 30 giây đến 3 phút

- Detailed Research: Phân tích toàn diện với cấu trúc rõ ràng

- Report Generation: Báo cáo chuyên nghiệp đầy đủ section và mục lục

- Document Analysis: Tìm kiếm bằng AI trên kho tài liệu riêng

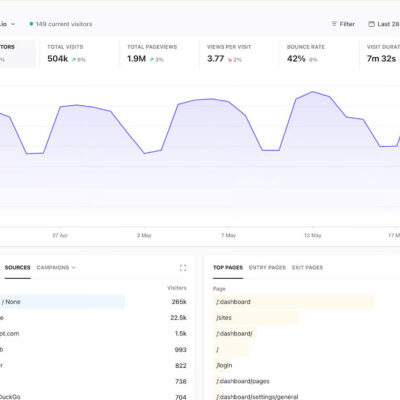

Ngoài ra, LDR còn có REST API với xác thực và database per-user, Analytics Dashboard theo dõi chi phí, hiệu năng và tích hợp LangChain để dùng bất kỳ vector store nào làm search engine.

Hướng dẫn cài đặt Local Deep Research

LDR cung cấp ba hướng triển khai, phù hợp với nhiều cấu hình và hệ điều hành khác nhau.

Cách 1: Docker Run (chỉ dành cho Linux native)

Phương án nhanh nhất nếu bạn dùng Linux, cần chạy ba container theo thứ tự:

# Bước 1: Cài Ollama và kéo model

docker run -d -p 11434:11434 --name ollama ollama/ollama

docker exec ollama ollama pull gpt-oss:20b

# Bước 2: Khởi chạy SearXNG cho kết quả tìm kiếm tối ưu

docker run -d -p 8080:8080 --name searxng searxng/searxng

# Bước 3: Khởi chạy Local Deep Research

docker run -d -p 5000:5000 --network host \

--name local-deep-research \

--volume "deep-research:/data" \

-e LDR_DATA_DIR=/data \

localdeepresearch/local-deep-researchLưu ý quan trọng: tham số --network host chỉ hoạt động trên Linux native. Người dùng macOS, Windows hoặc WSL2 cần dùng cách 2 (Docker Compose), nếu không port 5000 sẽ không truy cập được và container LDR không thấy được Ollama hay SearXNG.

Cách 2: Docker Compose (khuyến nghị cho mọi nền tảng)

Đây là cách dễ và đáng tin cậy nhất, hoạt động trên cả Windows, macOS và Linux:

# Bản CPU-only cho mọi nền tảng

curl -O https://raw.githubusercontent.com/LearningCircuit/local-deep-research/main/docker-compose.yml

docker compose up -dNếu bạn có GPU NVIDIA trên Linux và muốn tận dụng tối đa:

curl -O https://raw.githubusercontent.com/LearningCircuit/local-deep-research/main/docker-compose.yml

curl -O https://raw.githubusercontent.com/LearningCircuit/local-deep-research/main/docker-compose.gpu.override.yml

docker compose -f docker-compose.yml -f docker-compose.gpu.override.yml up -dKhoảng 30 giây sau khi container khởi động, mở trình duyệt và truy cập http://localhost:5000.

Cách 3: Cài bằng pip (phù hợp lập trình viên Python)

Nếu bạn đã có sẵn môi trường Python và muốn tích hợp sâu hơn:

pip install local-deep-research

python -m local_deep_research.web.appPhương án này yêu cầu bạn tự cài Ollama (hoặc bất kỳ endpoint tương thích OpenAI nào) và SearXNG. Trên Windows, nếu cần xuất PDF, bạn phải cài thêm Pango. Mã hoá SQLCipher đã đóng gói sẵn trong wheel, không cần compile.

Cách sử dụng LDR sau khi cài đặt

Sau khi giao diện web mở tại http://localhost:5000, quy trình cơ bản gồm các bước sau:

- Vào Settings và chọn provider LLM (Ollama, OpenAI-compatible…), nhập endpoint và tên model

- Cấu hình search engine: SearXNG cho web, kèm tuỳ chọn arXiv, PubMed, Semantic Scholar cho nghiên cứu học thuật

- Chọn strategy: với câu hỏi phức tạp, hãy chọn

langgraph-agentđể được kết quả tốt nhất - Đặt câu hỏi nghiên cứu của bạn, có thể đính kèm tài liệu riêng nếu muốn

- LDR sẽ tự động thực hiện chuỗi tìm kiếm, tổng hợp và sinh báo cáo có trích dẫn

Báo cáo cuối cùng có thể tải xuống dưới dạng Markdown hoặc PDF, đồng thời các nguồn tham khảo được tự động download vào Library mã hoá để dùng cho phiên tiếp theo.

Chọn model nào để chạy với LDR

Cộng đồng LDR duy trì một leaderboard chính thức trên Hugging Face (local-deep-research/ldr-benchmarks) theo dõi accuracy theo model, search engine và strategy. Một số kết quả tiêu biểu:

- Qwen3.6-27B: 95.7% SimpleQA, 77.0% xbench-DeepSearch

- Qwen3.5-9B: 91.2% SimpleQA, 59.0% xbench-DeepSearch

- gpt-oss-20B: 85.4% SimpleQA

Nếu bạn có GPU 24GB như RTX 3090 hoặc 4090, Qwen3.6-27B là lựa chọn tốt nhất. Với GPU yếu hơn, Qwen3.5-9B hoặc gpt-oss-20B vẫn cho kết quả rất tốt.

Tính minh bạch và bảo mật chuỗi cung ứng

Một điểm cộng lớn khác của LDR là tính minh bạch về bảo mật. Docker image được ký bằng Cosign, đính kèm SLSA provenance attestation và SBOM, giúp bạn xác minh nguồn gốc image:

cosign verify localdeepresearch/local-deep-research:latestMọi cảnh báo từ scanner đều được tài liệu hoá rõ ràng trong các file SECURITY_ALERTS.md, SECURITY_SCORECARD.md và .trivyignore.

Local Deep Research thực sự là một bước nhảy quan trọng của phong trào AI mã nguồn mở. Lần đầu tiên, một trợ lý nghiên cứu chạy local có thể đạt độ chính xác cạnh tranh trực tiếp với các dịch vụ cloud thương mại, đồng thời mang lại quyền riêng tư tuyệt đối và toàn quyền kiểm soát dữ liệu cho người dùng.

Nếu bạn là nhà nghiên cứu, kỹ sư AI, hay đơn giản là người dùng quan tâm đến quyền riêng tư, hãy ghé thăm repository Local Deep Research trên GitHub hoặc tham gia cộng đồng trên Discord và Reddit. Chỉ với một lệnh docker compose up -d, bạn đã có trong tay một trợ lý deep research thực sự thuộc về mình.