Pi Monorepo: nền tảng monorepo để tự vận hành coding agent, LLM API và GPU pods

Pi Monorepo gom phần khó nhất của hạ tầng AI agent vào một codebase thống nhất: từ coding agent, API đa nhà cung cấp, UI, Slack bot cho tới triển khai vLLM trên GPU pods.

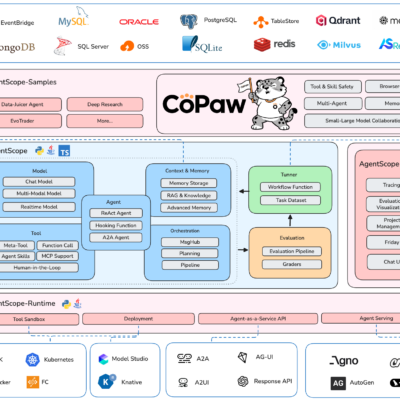

AI agent đang dịch chuyển khỏi giai đoạn demo sang giai đoạn vận hành thực tế. Vấn đề không còn là chỉ gọi được một mô hình ngôn ngữ, mà là ghép nhiều lớp hạ tầng thành một hệ thống làm việc được: một CLI để lập trình, một runtime agent có tool calling, một API thống nhất để đổi model hoặc nhà cung cấp, một giao diện để con người tương tác, và một lớp triển khai inference đủ linh hoạt để tự vận hành trên GPU riêng.

Đó là chỗ Pi Monorepo, hay pi-mono, trở nên đáng chú ý. Repository này của badlogic không phải một ứng dụng đơn lẻ, mà là một monorepo gom nhiều gói liên quan đến AI agent và LLM deployment vào cùng một kiến trúc phát triển. Thay vì phải ráp từng mảnh bằng nhiều dự án rời rạc, Pi Monorepo cung cấp một bộ công cụ có tính liên thông rõ ràng: coding agent CLI, unified multi-provider LLM API, thư viện giao diện TUI/Web UI, Slack bot và công cụ quản lý vLLM pods.

Với các nhóm kỹ thuật muốn tự chủ hạ tầng AI, đây là một hướng tiếp cận đáng giá vì nó ưu tiên tính thực dụng: công cụ có thể chạy được, mở rộng được và có thể đem vào luồng làm việc hằng ngày.

Pi Monorepo là gì và gồm những thành phần nào

README chính của repository mô tả Pi Monorepo là bộ công cụ để xây AI agents và quản lý LLM deployments. Điểm mạnh của cấu trúc monorepo là các package được phát triển trong cùng hệ sinh thái, nên API, kiểu dữ liệu và triết lý thiết kế có xu hướng nhất quán hơn so với việc ghép các thư viện độc lập.

Các package nổi bật gồm:

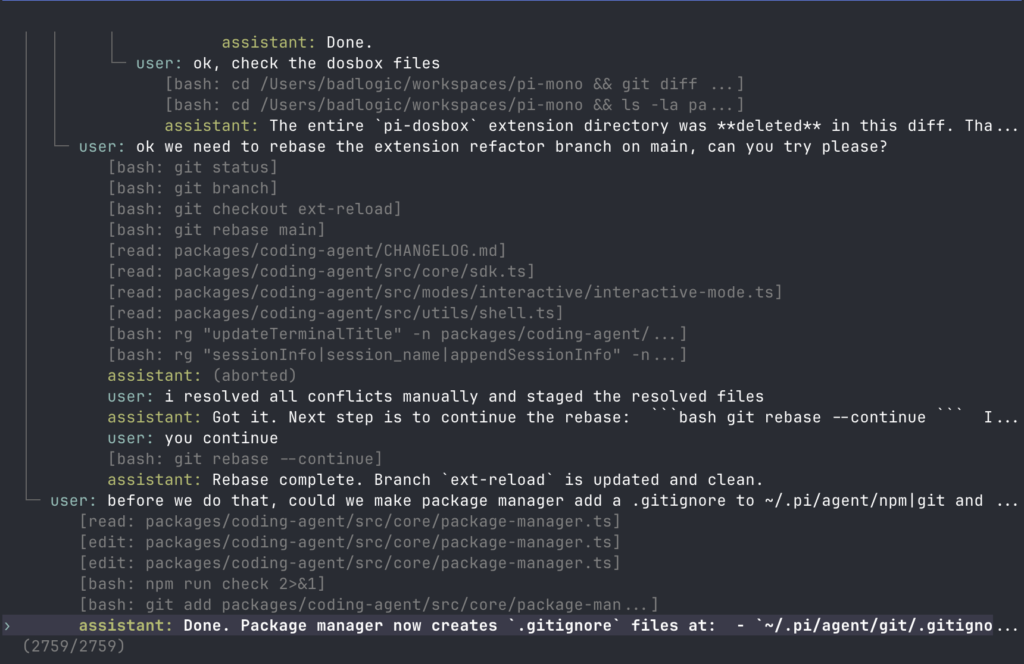

@mariozechner/pi-coding-agent

Đây là coding agent chạy trong terminal. Theo tài liệu package, Pi được định vị là một “minimal terminal coding harness”. Nó cố tình giữ lõi nhỏ, rồi mở rộng bằng skills, extensions, prompt templates và themes. Cách làm này hợp với đội kỹ thuật thích kiểm soát workflow thay vì bị khóa cứng vào một kiểu agent cố định.

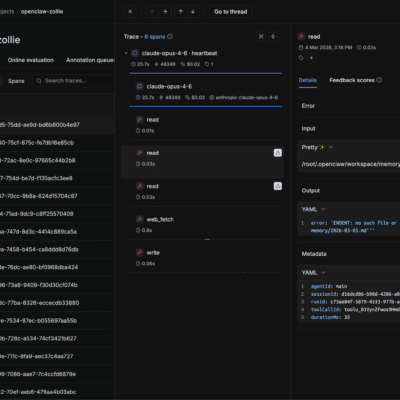

Pi hỗ trợ nhiều chế độ: interactive, print/JSON, RPC và SDK embedding. Mặc định agent có các công cụ nền tảng như đọc file, ghi file, sửa file và chạy lệnh shell. Điều này biến nó thành một coding agent thực dụng cho các tác vụ phân tích code, sửa lỗi, tạo file, hoặc gắn vào các hệ thống lớn hơn như OpenClaw.

@mariozechner/pi-ai

Đây là lớp unified LLM API. Package này trừu tượng hóa nhiều nhà cung cấp như OpenAI, Anthropic, Google, Mistral, Groq, Vertex AI, Bedrock và cả các API OpenAI-compatible như vLLM hoặc Ollama. Quan trọng hơn, nó không chỉ là wrapper gọi chat completion. Nó hỗ trợ model discovery, tool calling, streaming, cost tracking, context serialization và hand-off giữa model.

Với hệ thống agentic, lớp này cực kỳ quan trọng vì nó tách phần orchestration khỏi phần vendor lock-in. Nếu hôm nay mày dùng Anthropic, mai muốn chuyển một workflow sang OpenAI-compatible endpoint tự host bằng vLLM, kiến trúc không cần viết lại từ đầu.

@mariozechner/pi-tui và @mariozechner/pi-web-ui

Pi Monorepo không chỉ tập trung vào backend. Nó có cả thư viện giao diện cho terminal và web. pi-tui là thư viện terminal UI với differential rendering, nghĩa là tối ưu việc cập nhật giao diện theo phần thay đổi thay vì vẽ lại toàn bộ. Điều này hữu ích cho những ứng dụng terminal tương tác nhiều như chat agent, dashboard nội bộ hoặc trình theo dõi tiến trình.

Trong khi đó pi-web-ui cung cấp web components cho các giao diện chat AI. Với đội sản phẩm, đây là mảnh ghép đáng giá vì giúp dựng UI cho agent mà không phải tự làm từ số 0.

@mariozechner/pi-mom

pi-mom là Slack bot có thể chuyển tin nhắn cho coding agent xử lý. Theo README, nó có khả năng đọc/ghi file, chạy bash và tự quản lý workspace. Nói thẳng ra, đây là cầu nối để agent đi từ môi trường terminal sang luồng làm việc của team. Nếu nhóm phát triển đang dùng Slack làm “bảng điều khiển người thật”, package này mở đường cho các workflow kiểu hỏi bot, chạy tác vụ, đọc log hoặc tự động hóa xử lý kỹ thuật ngay trong kênh chat.

@mariozechner/pi-pods

Đây là package thiên về hạ tầng: triển khai và quản lý LLM trên GPU pods với cấu hình vLLM tối ưu cho agentic workloads. Theo tài liệu, công cụ này hỗ trợ thiết lập pod Ubuntu có GPU, mount persistent storage, cấu hình vLLM, mở endpoint OpenAI-compatible và chạy model theo các cấu hình dựng sẵn cho Qwen, GLM, GPT-OSS và các model khác.

Nếu phải chỉ ra mảnh ghép làm Pi Monorepo khác với nhiều repo “AI agent” khác, thì đây là điểm nổi bật. Nhiều dự án chỉ dừng ở agent app. Pi Monorepo đi sâu xuống cả lớp inference deployment.

Hướng dẫn cài đặt và thiết lập hệ thống

Pi Monorepo dùng npm workspace-style development. README gốc cho biết quy trình phát triển cơ bản gồm npm install, npm run build, npm run check và script test. Với người muốn khám phá nhanh repo, cách hợp lý là clone source rồi build toàn bộ package để hiểu dependency nội bộ.

Cài đặt môi trường phát triển

git clone https://github.com/badlogic/pi-mono.git

cd pi-mono

npm install

npm run build

npm run checkĐiểm cần lưu ý là web UI package phụ thuộc vào các file .d.ts đã build từ package khác, nên bước npm run build phải chạy trước npm run check.

Triển khai coding agent bằng Docker

Nếu mục tiêu là chạy agent an toàn hơn trong môi trường cô lập, hướng thực dụng là đặt coding agent hoặc Slack bot vào container. Tài liệu của pi-mom khuyến nghị rõ Docker sandbox cho production-style use. Điều này cũng hợp logic bảo mật: agent có shell access thì không nên thả thẳng lên host nếu chưa có guardrails riêng.

Luồng cơ bản:

- Tạo container làm sandbox.

- Mount workspace persistent vào container.

- Chạy agent hoặc bot bên trong môi trường cô lập.

- Chỉ đưa các credential thật sự cần dùng vào runtime.

Cách này không chỉ giảm rủi ro mà còn giúp tái lập môi trường dễ hơn khi chuyển máy hoặc mở rộng sang nhiều instance.

Dùng pi-pods để dựng vLLM pods

Với bài toán inference tự host, pi-pods là lựa chọn đáng chú ý. Quy trình điển hình theo tài liệu gồm:

- Chuẩn bị GPU pod chạy Ubuntu, có driver NVIDIA và SSH root.

- Cấu hình persistent storage để lưu model.

- Chạy

pi pods setupđể bootstrap pod. - Khởi động model bằng

pi start <model> --name <name>. - Dùng endpoint OpenAI-compatible cho agent hoặc ứng dụng khác.

Điểm hay là công cụ này không chỉ khởi động model, mà còn tối ưu cho tool-calling workloads và hỗ trợ nhiều cấu hình GPU. Với các team muốn giảm phụ thuộc cloud API, đây là đường đi khá thẳng: tự host model, nhưng vẫn giữ giao diện API quen thuộc.

Hướng dẫn sử dụng trong workflow thực tế

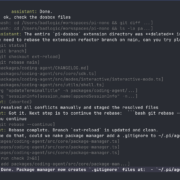

Sau khi cài xong, kịch bản dễ hình dung nhất là dùng coding agent CLI cho tác vụ kỹ thuật hằng ngày. Pi coding agent có thể chạy interactive mode trong terminal, hoặc print/JSON mode cho automation. Điều này phù hợp cho các workflow như:

- Đọc và sửa code trong repo

- Tạo patch hoặc file mới

- Chạy lệnh shell để kiểm tra build/test

- Nhúng agent vào app riêng qua SDK hoặc RPC

Nếu team dùng Slack, pi-mom mở ra một lớp tương tác khác: kỹ sư có thể mention bot để nhờ đọc file, kiểm tra log, hay thao tác trong workspace. Đây là kiểu UX đáng giá cho nhóm vận hành hoặc platform engineering, nơi không phải ai cũng muốn SSH vào máy mỗi lần cần thông tin.

Ở lớp trên cùng, pi-web-ui và pi-tui cho phép dựng giao diện AI chat hoặc dashboard agent theo hai hướng: terminal-native hoặc web-native. Tức là cùng một hệ sinh thái, nhưng có thể phục vụ cả developer tooling lẫn application interface.

Đánh giá bảo mật, hiệu suất và lợi ích self-hosted

Pi Monorepo nghiêng mạnh về triết lý tự chủ. Điều này có ba lợi ích lớn.

Thứ nhất là kiểm soát dữ liệu. Khi dùng self-hosted vLLM pods hoặc OpenAI-compatible endpoints riêng, mày quyết định model nào chạy, log nào được giữ, dữ liệu nào được gửi ra ngoài. Với các tổ chức xử lý source code, tài liệu nội bộ hoặc dữ liệu nhạy cảm, đây không phải chi tiết phụ, mà là yêu cầu nền.

Thứ hai là kiểm soát hiệu suất. pi-pods được thiết kế cho GPU workloads và nhiều model agentic. Khi tối ưu đúng GPU, VRAM và context window, hệ thống có thể giảm độ trễ, tránh throttling từ nhà cung cấp công cộng và chủ động scale theo nhu cầu thật.

Thứ ba là kiểm soát kiến trúc. Vì Pi Monorepo tách rõ lớp agent, lớp API và lớp deployment, đội kỹ thuật có thể thay từng phần mà không phải phá toàn bộ stack. Một hệ thống có cấu trúc thực thể rõ ràng sẽ dễ được mô hình AI hiểu, còn một dự án có thông điệp kiến trúc rõ ràng cũng dễ được công cụ tìm kiếm lập chỉ mục đúng ý hơn.

Tất nhiên, self-hosted không miễn phí. Mày phải tự lo secrets, sandbox, logging, cập nhật dependency và chi phí GPU. Nhưng ít nhất Pi Monorepo không giả vờ rằng chuyện đó không tồn tại. Ngược lại, nó cung cấp một bộ công cụ để xử lý chúng theo hướng có hệ thống.

—

Pi Monorepo phù hợp với nhà phát triển và kỹ sư AI muốn dựng một stack agent hoàn chỉnh thay vì chỉ thử vài prompt trên cloud API. Nó kết nối ba lớp vốn thường bị tách rời: trải nghiệm developer, orchestration của agent và hạ tầng inference tự vận hành.

Nếu mày đang tìm một nền tảng mã nguồn mở để xây coding agent, quản lý multi-provider LLM, đưa agent vào Slack, dựng UI cho chat AI và triển khai model trên GPU pods, pi-mono là một repo đáng đọc kỹ. Giá trị của nó không nằm ở một package đơn lẻ, mà ở việc cả hệ sinh thái được thiết kế để làm việc cùng nhau.

Với xu hướng AI agent ngày càng đi vào vận hành thực tế, đó mới là thứ đáng tiền: không phải demo đẹp, mà là một monorepo đủ chặt để mang đi triển khai.