Tóm tắt nhanh (Key Takeaways)

- Osaurus là một “AI edge infrastructure” native cho macOS, biến máy Mac Apple Silicon của bạn thành runtime AI riêng: chạy cả model local (MLX, Apple Foundation Models) lẫn model cloud (OpenAI, Anthropic, Gemini, Ollama…), expose API tương thích OpenAI/Ollama và chia sẻ tools chung qua MCP cho mọi ứng dụng AI trên máy.

- Bạn cài Osaurus như một app macOS nhẹ (khoảng vài MB), bật server luôn‑chạy, thêm model local qua Model Manager, kết nối API cloud nếu cần, sau đó trỏ các công cụ như Cursor, Claude Desktop, script Python/JS, hoặc bất kỳ OpenAI/Ollama/MCP client nào về Osaurus để dùng chung models, tools, agents, schedules và voice workflows.

Osaurus là gì và vì sao đáng chú ý?

Osaurus được giới thiệu như một “AI edge infrastructure for macOS” – một runtime AI native cho Apple Silicon, cho phép bạn chạy cả model local lẫn cloud, chia sẻ tools giữa ứng dụng qua Model Context Protocol (MCP) và vận hành workflow AI luôn‑chạy ngay trên máy cá nhân. Về kiến trúc, nó không chỉ là UI chat mà là một lớp hạ tầng gồm server, CLI, plugin, personas, skills, schedules và watchers để bất kỳ app tương thích OpenAI/Ollama/MCP nào cũng có thể kết nối và tận dụng.

Osaurus tận dụng MLX để tối ưu hoá inference model lớn trên Apple Silicon, đồng thời tích hợp sẵn support cho OpenAI, Anthropic, Gemini và Ollama, nên bạn vừa có thể chạy model local (Llama, Qwen, Gemma, Mistral…) vừa có thể kết hợp model cloud trong cùng một runtime. Dự án mang giấy phép MIT, codebase bằng Swift, UI native macOS, kích thước app khoảng vài-chục MB nhưng cung cấp đầy đủ server API, MCP server/client và hệ sinh thái plugin.

Những điểm khác biệt nổi bật của Osaurus

Osaurus khác với các “LLM app cho Mac” thông thường ở chỗ nó đóng vai trò một lớp hạ tầng AI tổng thể:

- Chạy model local bằng MLX + Apple Neural Engine

Osaurus sử dụng runtime MLX để chạy local LLM như Llama 3.2, Qwen, Gemma, Mistral trên Apple Silicon, với performance được tối ưu cho M‑series và Apple Neural Engine. Model được tải trực tiếp từ Hugging Face qua Model Manager, lưu trên đĩa (2-20GB mỗi model tuỳ kích thước). - API tương thích OpenAI & Ollama

Osaurus expose endpoint/v1/chat/completionsgiống OpenAI và các endpoint kiểu/v1/models,/v1/tags,/chattương thích Ollama, nên bạn có thể dùng lại hầu hết SDK OpenAI/Ollama (Python, JS, LangChain…) chỉ bằng cách đổibase_urlsanghttp://127.0.0.1:<port>. - MCP server và MCP remote providers

Osaurus hoạt động như một MCP server với các endpoint/mcp/health,/mcp/tools,/mcp/call, cung cấp bộ tools (filesystem, browser, git, web search, v.v.) cho agent trong các ứng dụng như Cursor hoặc Claude Desktop. Nó cũng có thể kết nối tới các MCP server bên ngoài, aggregate tool của chúng và namespace theo dạngprovider_toolname. - Plugin & tools system phong phú

Osaurus đi kèm nhiều system tools (đọc/ghi file, list directory, điều khiển browser, chạy git, web search…) và hỗ trợ registry tools cộng đồng thông qua repo osaurus‑tools. Bạn có thể cài tools bằng CLI nhưosaurus tools install osaurus.browservà expose chúng cho agents. - Personas, skills, schedules & watchers

Bạn định nghĩa personas (assistant với prompt, model, tools, theme riêng), import skills (khả năng tái sử dụng từ GitHub hoặc file local), thiết lập schedules và watchers để chạy tác vụ định kỳ hoặc sự kiện‑dựa‑trên‑file. Điều này cho phép xây dựng workflow như “assistant nghiên cứu hàng tuần” hay “agent tự tóm tắt file mới trong folder”. - Voice workflows với WhisperKit

Osaurus tích hợp WhisperKit để nhận diện giọng nói realtime on‑device, hỗ trợ voice commands, dictation và transcription hotkey toàn hệ thống mà không cần internet. Bạn có thể bật VAD mode, luôn lắng nghe với wake word, hoặc dùng hotkey để đổ transcript vào bất kỳ ô nhập liệu nào (Notion, Obsidian, Xcode…).

Yêu cầu hệ thống và kiến trúc local-first

Theo tài liệu chính thức, Osaurus yêu cầu:

- macOS 15.5 hoặc mới hơn

- Apple Silicon: M1, M2, M3 hoặc mới hơn

- 2-20GB trống cho mỗi model, tuỳ dung lượng model được tải về

Đối với các tính năng Apple Foundation Models và Apple Intelligence, bạn cần macOS Tahoe (macOS 26) trở lên và bật Apple Intelligence trong System Settings. Osaurus được xây dựng hoàn toàn bằng Swift, chạy native macOS, size app khoảng cỡ 10MB với startup gần như instant – đây là lợi thế lớn so với các giải pháp Electron hoặc container.

Về kiến trúc, Osaurus tách rõ layer CLI, core, UI và networking; CLI và GUI chia sẻ backend chung, API server cung cấp endpoint OpenAI/Ollama/MCP, trong khi UI SwiftUI/AppKit chịu trách nhiệm điều khiển server, Model Manager, cấu hình plugin và debug. Cách tách lớp này giúp bạn vừa có thể dùng UI, vừa có thể tích hợp sâu bằng CLI và API.

Cài đặt Osaurus trên macOS Apple Silicon

Bước 1: Tải và cài app Osaurus

Osaurus được phân phối dưới dạng native macOS app cho Apple Silicon và có thể tải từ website chính thức hoặc GitHub osaurus-ai.

- Truy cập trang chủ Osaurus tại osaurus.ai và bấm Install Osaurus để tải bản mới nhất cho macOS.

- Hoặc vào GitHub osaurus-ai/osaurus và tải build đã ký từ tab Releases (trong repo gốc trước đây là

dinoki-ai/osaurus). - Kéo file app vào thư mục Applications như các ứng dụng macOS khác.

Nếu ae đã cài brew thì dùng lệnh này:

brew install --cask osaurusNếu macOS chặn app vì developer không từ App Store, bạn vào System Settings → Privacy & Security, tìm Osaurus trong phần “Security”, rồi bấm Open Anyway để cho phép chạy.

Bước 2: Thiết lập CLI osaurus (tuỳ chọn nhưng rất nên làm)

Để gọi Osaurus từ terminal và dùng trong script/SDK, bạn cần thêm CLI vào PATH.

Cách 1 – tạo symlink:

sudo ln -sf /Applications/Osaurus.app/Contents/MacOS/osaurus /usr/local/bin/osaurus

osaurus --versionCách 2 – thêm trực tiếp vào PATH:

echo 'export PATH="/Applications/Osaurus.app/Contents/MacOS:$PATH"' >> ~/.zshrc

source ~/.zshrcNếu sau đó lệnh osaurus vẫn không nhận, docs gợi ý kiểm tra đường dẫn app và dùng brew --prefix để tạo symlink vào $(brew --prefix)/bin/osaurus.

Thiết lập ban đầu: bật server và tải model local

Sau khi cài, bạn mở Osaurus từ Applications:

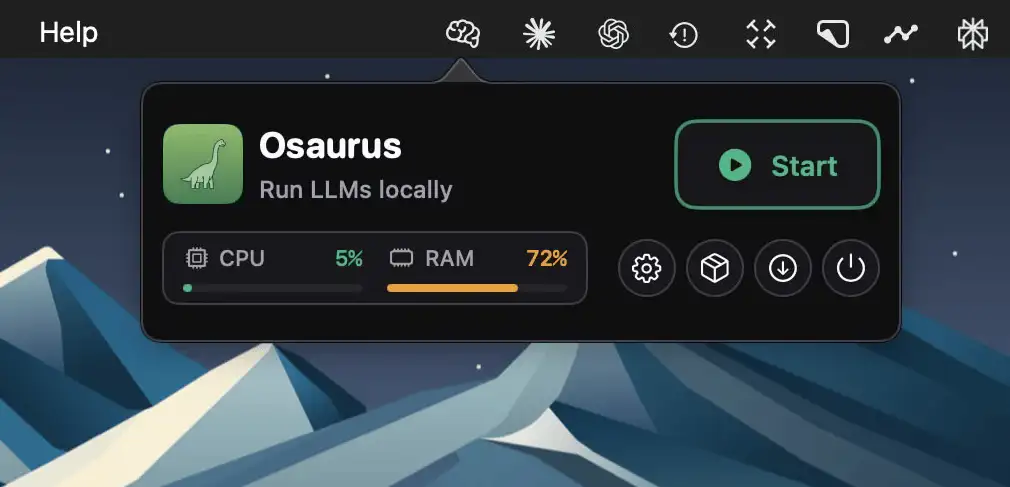

- Trong UI chính (ContentView), bạn chọn port cho server (ví dụ 8080 hoặc 1337) rồi bấm Start để bật AI server luôn‑chạy trên máy.

- Mở Model Manager để duyệt danh sách model gợi ý (Llama 3.2 3B Instruct 4bit, Qwen, Gemma, Mistral, v.v.) và bấm download; Osaurus sẽ dùng metadata Hugging Face để ước lượng dung lượng tải.

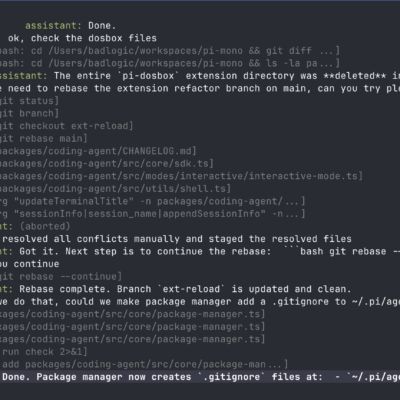

Khi đã tải xong một model (ví dụ llama-3.2-3b-instruct-4bit), bạn có thể test nhanh bằng CLI:

osaurus run llama-3.2-3b-instruct-4bithoặc bằng lệnh curl gọi API OpenAI‑compatible:

curl http://127.0.0.1:1337/v1/chat/completions \

-H "Content-Type: application/json" \

-d '{

"model": "llama-3.2-3b-instruct-4bit",

"messages": [{"role": "user", "content": "Hello from Osaurus!"}]

}'Dùng Osaurus như server OpenAI/Ollama cục bộ

Nhờ API tương thích, bạn có thể chuyển mọi tool đang dùng OpenAI/Ollama sang chạy qua Osaurus gần như không cần sửa code.

Ví dụ với OpenAI Python SDK:

from openai import OpenAI

client = OpenAI(

base_url="http://127.0.0.1:8080/v1",

api_key="osaurus" # bất kỳ chuỗi placeholder

)

resp = client.chat.completions.create(

model="llama-3.2-3b-instruct-4bit",

messages=[{"role": "user", "content": "Hello there!"}],

)

print(resp.choices[0].message.content)Hoặc dùng endpoint tương thích Ollama cho streaming NDJSON:

curl -N http://127.0.0.1:8080/v1/api/chat \

-H "Content-Type: application/json" \

-d '{

"model": "llama-3.2-3b-instruct-4bit",

"messages": [{"role":"user","content":"Tell me about dinosaurs"}],

"stream": true

}'Điểm mạnh là bạn có thể:

- Trộn local models (MLX) với cloud models (OpenAI, Anthropic, Gemini, Ollama remote) trong cùng runtime.

- Dùng Osaurus làm layer proxy/huấn luyện, thêm logic trước/sau request (tools, memory, personas) mà không cần sửa ứng dụng client.

Chia sẻ tools giữa ứng dụng qua MCP

Model Context Protocol (MCP) giúp chuẩn hoá cách agent truy cập tools bên ngoài (filesystem, web, API nội bộ, v.v.), và Osaurus đóng vai trò hub MCP trên macOS.

Osaurus:

- Chạy như MCP server, expose health, danh sách tools, và endpoint gọi tools qua

/mcp/health,/mcp/tools,/mcp/call. - Cung cấp sẵn một loạt system tools: thao tác file (

read_file,list_directory), browser automation (browser_navigate), git (git_status), web search và các plugin khác, cài bằngosaurus tools install <plugin-id>. - Có thể kết nối tới MCP server bên ngoài, aggregate tool của họ và đặt namespaced như

provider_toolname.

Nhờ đó, bạn có thể:

- Để Cursor/Claude Desktop kết nối tới Osaurus như một MCP provider, từ đó mọi agent trong các app này đều có chung bộ tools và models do bạn kiểm soát.

- Cài thêm plugin Swift tự viết để expose khả năng của app/macOS (lịch, audio, automation…) cho nhiều agent khác nhau mà không cần tích hợp lại từng lần.

Tự động hoá workflow với personas, skills, schedules và watchers

Osaurus không chỉ cho chat theo phiên mà còn hướng tới “AI workflows luôn‑chạy” trên Mac của bạn.

- Personas: mỗi persona có system prompt, model, tools, theme riêng, có thể export/import dưới dạng JSON, giúp bạn chia vai: code reviewer, research analyst, journaling coach, v.v.

- Skills: gói khả năng tái sử dụng (theo chuẩn Agent Skills) mà bạn có thể import từ GitHub hoặc file local (.md, .json, .zip), bao gồm sẵn các skill như Research Analyst, Debug Assistant…

- Schedules: cho phép đặt lịch chạy prompt + persona + tools theo chu kỳ, ví dụ: mỗi sáng 8h tóm tắt RSS, mỗi thứ Hai tổng hợp báo cáo tuần từ folder PDF.

- Watchers: (tuỳ release) theo dõi thay đổi trong filesystem hoặc nguồn dữ liệu rồi trigger persona tương ứng, giúp tự động hoá “khi có file mới → tóm tắt ngay”.

Kết hợp với voice input WhisperKit, bạn có thể xây workflow như “nói nhanh ghi chú, Osaurus transcribe + tóm tắt + lưu vào file markdown” hoàn toàn local‑first, không qua cloud.

Một vài use case tiêu biểu với Osaurus trên macOS

Từ tài liệu và các bài giới thiệu, có thể thấy Osaurus nhắm tới nhiều kịch bản khác nhau:

- AI coding assistant riêng tư

Chạy Llama 3.2 local qua MLX, cho agent truy cập git & filesystem qua MCP, rồi kết nối Cursor để có code assistant offline, tận dụng context code trên máy mà không gửi full repo ra ngoài. - Research & reporting workflow

Định nghĩa persona “Research Analyst” dùng tools web search + read_file, đặt schedule tuần để quét bộ PDF trong thư mục Documents và sinh báo cáo kèm ghi chú, trích dẫn. - Voice‑first note taking và automation

Dùng transcription hotkey để nói ghi chú, cho persona “Knowledge Organizer” gắn tag, phân loại và lưu vào vault (Notion/Obsidian/Git repo) thông qua plugins. - DevOps/CI pipelines tận dụng local LLM

Deploy Osaurus trên workstation Apple Silicon trong team, expose API OpenAI‑compatible để script CI/CD gọi cho việc generate docs, review code, viết release note… mà không tốn token cloud đắt đỏ. - Hạ tầng chung cho nhiều app AI

Dùng Osaurus làm trung tâm: Claude Desktop, Cursor, Dinoki và các app khác cùng trỏ về, dùng chung models, tools, memory và schedules.

Với Osaurus, bạn thực sự có thể biến máy Mac thành “server AI cá nhân”: local‑first, native, luôn‑chạy, linh hoạt dùng đồng thời model local và cloud, và quan trọng hơn là cung cấp một lớp hạ tầng chuẩn hoá (OpenAI/Ollama/MCP) để mọi ứng dụng AI trên macOS cùng chia sẻ tài nguyên và workflow.