Deep-Live-Cam: Bước đột phá giúp hoán đổi khuôn mặt thời gian thực trở nên đơn giản đến mức chỉ cần một ảnh

Deep-Live-Cam biến một bài toán từng rất phức tạp trong Computer Vision thành trải nghiệm gần như “chọn ảnh, mở webcam, bấm chạy”, nhưng chính sự đơn giản đó cũng khiến yêu cầu về sử dụng AI có trách nhiệm trở nên quan trọng hơn bao giờ hết.

Deep-Live-Cam là gì và tại sao nó lại đặc biệt

Deep-Live-Cam là một dự án AI mã nguồn mở tập trung vào hai trải nghiệm chính: face swap AI thời gian thực qua webcam và tạo video deepfake offline chỉ với một ảnh khuôn mặt nguồn. Điểm khiến dự án này bùng nổ là cách nhóm phát triển đóng gói quy trình xử lý rất khó của Vision AI thành một workflow dễ hiểu: chọn ảnh khuôn mặt, chọn camera hoặc video đích, rồi bấm chạy. Repo mô tả rõ đây là công cụ “real-time face swap and video deepfake with a single click and only a single image”.

Điểm đặc biệt thứ hai là Deep-Live-Cam không chỉ là một bản demo. Từ tài liệu và mã nguồn có thể thấy dự án hỗ trợ nhiều tình huống thực tế như live show, video call, thay mặt trong video quay sẵn, face mapping cho nhiều người, giữ nguyên vùng miệng bằng mouth mask và tăng chất lượng khuôn mặt bằng face enhancer. Chính sự kết hợp giữa tính dễ dùng và tập tính năng phong phú khiến nó hấp dẫn cả người dùng phổ thông lẫn nhà phát triển AI.

Cơ chế “One-click face swap” hoạt động như thế nào

Pipeline thị giác máy tính đằng sau giao diện đơn giản

Dù giao diện rất tối giản, lõi xử lý của Deep-Live-Cam vẫn dựa trên một pipeline khá rõ ràng. Theo mã nguồn face_swapper.py, dự án dùng insightface.model_zoo.get_model để nạp mô hình hoán đổi khuôn mặt inswapper_128_fp16.onnx hoặc inswapper_128.onnx, phát hiện và xử lý khuôn mặt trên từng khung hình, sau đó trộn kết quả bằng các bước như tạo mặt nạ khuôn mặt, chuyển màu và hòa trộn bằng OpenCV. Nói cách khác, “one-click” là phần trải nghiệm; còn bên dưới là chuỗi face detection, face embedding, face swap inference và blending theo thời gian thực hoặc theo từng frame video.

Repo cũng cho thấy dự án không chỉ xử lý một ảnh tĩnh. Trong mã nguồn có các hàm riêng cho xử lý ảnh đơn, frame đơn, batch frame và video frame list, cùng hỗ trợ many_faces, map_faces và mouth_mask. Điều này rất quan trọng nếu bạn muốn hoán đổi nhiều khuôn mặt trong cùng một cảnh hoặc gán đúng ảnh nguồn cho từng khuôn mặt đích trong một video nhiều người.

Vì sao webcam live swap có thể chạy thời gian thực

Ở tầng phụ thuộc, Deep-Live-Cam dùng OpenCV, InsightFace, ONNX, ONNX Runtime, thư viện enumerate camera, GUI bằng tkinter/customtkinter và có các execution provider khác nhau cho CUDA, CoreML, DirectML hoặc OpenVINO. Cấu trúc dependency này cho thấy dự án được thiết kế để tối ưu đường đi suy luận theo phần cứng sẵn có, thay vì khóa cứng vào một backend duy nhất. Đó là lý do nó có thể chạy trên GPU Nvidia, Apple Silicon, Windows với DirectML hoặc CPU nếu cần.

Yêu cầu hệ thống cho Deep-Live-Cam

Cấu hình tối thiểu và cấu hình nên dùng

Về cơ bản, bạn cần Python, pip, git, FFmpeg và trên Windows còn cần Visual Studio 2022 Runtimes. Repo khuyến nghị Python 3.11 cho cài đặt chung, nhưng phần hướng dẫn Apple Silicon/CoreML lại có ghi chú riêng về Python 3.10 cho một số tình huống chạy CoreML. Vì tài liệu có điểm chưa hoàn toàn đồng nhất giữa các phần, cách an toàn nhất là bám đúng execution provider mà bạn định dùng.

Nếu chỉ chạy CPU, Deep-Live-Cam vẫn hoạt động nhưng sẽ chậm hơn đáng kể. Với trải nghiệm face swap AI thời gian thực qua webcam, GPU là lựa chọn nên ưu tiên. Repo có hướng dẫn riêng cho CUDA trên Nvidia, CoreML trên Apple, DirectML trên Windows và OpenVINO cho Intel. Với người làm nội dung hoặc livestream, GPU gần như là điều kiện cần để preview mượt và giảm độ trễ.

Các mô hình và thư viện cốt lõi

Hai mô hình được README yêu cầu tải thủ công là GFPGANv1.4.onnx và inswapper_128_fp16.onnx, đặt trong thư mục models. Mô hình inswapper đảm nhiệm phần hoán đổi khuôn mặt, còn GFPGAN phục vụ khôi phục hoặc làm đẹp khuôn mặt sau xử lý. Ngoài ra, dependency opennsfw2 cho thấy dự án có thêm lớp kiểm tra nội dung nhạy cảm nhằm hạn chế lạm dụng.

Hướng dẫn cài đặt chi tiết

Cài đặt môi trường Python và phụ thuộc

Quy trình cài đặt thủ công chuẩn của repo là clone mã nguồn, tạo virtual environment, cài dependencies rồi tải model. Đây là lựa chọn phù hợp cho nhà phát triển AI hoặc người dùng muốn tùy biến sâu hơn thay vì dùng bản dựng sẵn.

git clone https://github.com/hacksider/Deep-Live-Cam.git

cd Deep-Live-Cam

python -m venv venv

source venv/bin/activate # Linux/macOS

# hoặc venv\Scripts\activate trên Windows

pip install -r requirements.txtSau đó tải hai model được repo chỉ định và đặt vào thư mục models:

- GFPGANv1.4: https://huggingface.co/hacksider/deep-live-cam/resolve/main/GFPGANv1.4.onnx

- inswapper_128_fp16: https://huggingface.co/hacksider/deep-live-cam/resolve/main/inswapper_128_fp16.onnx

Kích hoạt tăng tốc phần cứng

Nếu dùng Nvidia, README hướng dẫn cài CUDA Toolkit 12.8.0, cuDNN v8.9.7 cho CUDA 12.x, sau đó cài torch, torchvision, torchaudio từ index phù hợp và thay onnxruntime bằng onnxruntime-gpu. Với Windows GPU không phải Nvidia, repo gợi ý DirectML; còn Intel thì có OpenVINO. Đây là điểm rất đáng giá vì nó làm Deep-Live-Cam dễ tiếp cận hơn nhiều loại phần cứng.

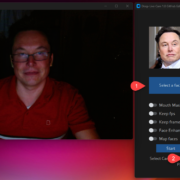

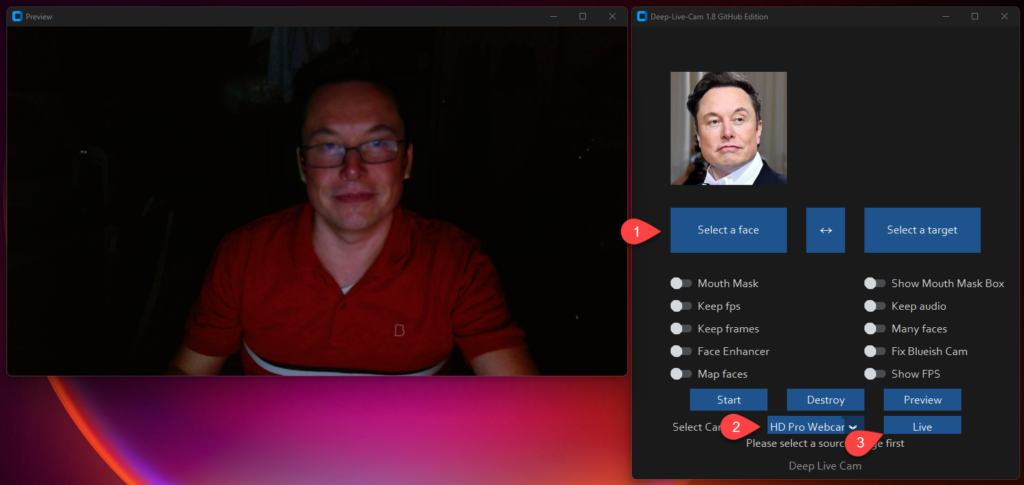

Cách sử dụng tính năng live swap qua webcam

Repo mô tả quy trình webcam mode rất trực diện: chạy python run.py, chọn ảnh khuôn mặt nguồn, bấm Live, chờ preview xuất hiện trong khoảng 10 đến 30 giây, rồi dùng công cụ như OBS để stream hoặc capture đầu ra. Khi muốn đổi gương mặt, bạn chỉ cần chọn ảnh nguồn khác. run.py thực tế chỉ khởi động core.run(), cho thấy ứng dụng chủ yếu được đóng gói dưới dạng GUI, dù repo vẫn có CLI arguments cho người dùng nâng cao.

Để đạt chất lượng tốt nhất khi live swap, ảnh nguồn nên là ảnh chính diện hoặc gần chính diện, độ phân giải đủ cao, ánh sáng đều, ít bóng đổ và không bị che bởi tóc, kính râm hoặc vật cản. Với webcam, chất lượng ánh sáng của cảnh thực tế ảnh hưởng rất nhiều đến độ ổn định nhận diện và hòa trộn khuôn mặt; ánh sáng mềm phía trước mặt thường cho kết quả tốt hơn nguồn sáng gắt từ trên đầu hoặc từ phía sau. Đây là khuyến nghị thực tế dựa trên cách pipeline face detection và blending thường hoạt động trong các hệ thống Vision AI thời gian thực.

Cách xử lý video deepfake chỉ với một cú nhấp chuột

Ở chế độ image/video, bạn chạy python run.py, chọn ảnh nguồn và file đích là ảnh hoặc video, rồi nhấn Start. Kết quả sẽ được lưu vào một thư mục được đặt tên theo video đích. Đây là workflow phù hợp cho người làm nội dung ngắn, creator muốn thử ý tưởng hình ảnh hoặc nhà nghiên cứu muốn kiểm tra chất lượng hoán đổi trên clip đã quay sẵn.

Với người dùng nâng cao, repo còn liệt kê các cờ CLI như --many-faces, --map-faces, --mouth-mask, --keep-fps, --keep-audio, --video-encoder, --video-quality và --execution-provider. Dù phần CLI được đánh dấu là “unmaintained”, danh sách này vẫn rất hữu ích để hiểu khả năng xử lý video offline của dự án: giữ FPS gốc, giữ audio, chọn encoder, xử lý nhiều khuôn mặt hoặc tối ưu chất lượng đầu ra.

Mẹo để có chất lượng hình ảnh tốt nhất

Tối ưu ảnh nguồn và cảnh đích

Ảnh nguồn lý tưởng là ảnh rõ nét, mặt không quá nghiêng, mắt mở, biểu cảm trung tính hoặc gần với biểu cảm mong muốn. Nếu gương mặt nguồn có ánh sáng và góc chụp quá khác cảnh đích, mô hình vẫn có thể swap được nhưng cảm giác hòa trộn sẽ kém tự nhiên hơn. Tính năng mouth mask đặc biệt hữu ích khi bạn cần giữ chuyển động miệng gốc cho các cảnh nói chuyện hoặc livestream.

Sử dụng AI có trách nhiệm

Đây là phần không thể thiếu khi nói về Deep-Live-Cam. Repo chính thức nêu rõ người dùng phải có sự đồng ý của người thật nếu dùng khuôn mặt của họ, cần gắn nhãn nội dung deepfake khi chia sẻ trực tuyến, và phần mềm có cơ chế chặn xử lý nội dung không phù hợp như ảnh khỏa thân, hình ảnh bạo lực hoặc tư liệu nhạy cảm. Nhóm phát triển cũng tuyên bố có thể thêm watermark hoặc đóng dự án nếu pháp luật yêu cầu. Đây là tín hiệu tốt về E-E-A-T vì nó cho thấy nhà phát triển ý thức rất rõ rủi ro xã hội của công nghệ deepfake.

Ngoài ra, phần credit của repo cũng nhắc rằng một số thành phần liên quan đến InsightFace có điều khoản sử dụng cho mục đích nghiên cứu phi thương mại. Vì vậy, nếu bạn định đưa Deep-Live-Cam vào workflow thương mại, hãy kiểm tra kỹ giấy phép của từng mô hình và thư viện đi kèm, thay vì chỉ nhìn vào giấy phép của repo chính.

Deep-Live-Cam là ví dụ điển hình cho xu hướng dân chủ hóa Vision AI: từ một pipeline face swap AI phức tạp thành một công cụ có thể cài bằng Python, chạy bằng GUI và tạo kết quả gần thời gian thực chỉ với một ảnh duy nhất. Với creator, đây là công cụ thử nghiệm ý tưởng rất nhanh. Với nhà phát triển AI, đây là một case study đáng chú ý về cách kết hợp InsightFace, ONNX Runtime, OpenCV, GFPGAN và nhiều backend phần cứng vào một sản phẩm mã nguồn mở có tính lan truyền cao. Nhưng càng dễ dùng, trách nhiệm sử dụng càng phải cao: luôn xin phép, luôn minh bạch, và luôn cân nhắc tác động đạo đức trước khi tạo bất kỳ nội dung deepfake nào.