Open Claude: Coding agent CLI mã nguồn mở giúp bạn tự do chọn mô hình AI cho quy trình lập trình

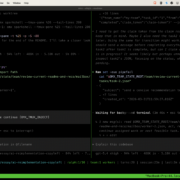

Open Claude là một coding-agent CLI mã nguồn mở dành cho developer muốn dùng cùng một giao diện terminal-first để làm việc với nhiều nhà cung cấp mô hình khác nhau, từ OpenAI-compatible API, Gemini, DeepSeek, Codex, GitHub Models cho đến Ollama và các local server kiểu

/v1. Điểm mạnh thực sự của công cụ không chỉ là “chạy được nhiều model”, mà là giữ nguyên workflow coding-agent gồm prompt, tool calling, agent, MCP, slash command và streaming output trong khi cho phép bạn thay đổi backend phù hợp với chi phí, độ trễ và yêu cầu bảo mật. Nếu bạn muốn một CLI AI linh hoạt hơn các giải pháp bị khóa vào một nhà cung cấp, Open Claude là một dự án rất đáng thử.

Vì sao Open Claude xuất hiện đúng lúc

Xu hướng coding agent đang chuyển từ mô hình “AI trả lời câu hỏi” sang “AI trực tiếp thao tác trên codebase”. Điều đó đòi hỏi một CLI có thể đọc file, sửa file, chạy lệnh shell, grep, glob, điều phối task và giữ được ngữ cảnh hội thoại trong terminal. Open Claude định vị mình như một coding-agent CLI mã nguồn mở, giữ nguyên tư duy terminal-first nhưng mở backend sang nhiều nhà cung cấp mô hình khác nhau thay vì phụ thuộc vào một hãng duy nhất.

Điểm đáng chú ý nhất là khả năng tương thích đa mô hình. README của dự án mô tả rõ Open Claude hoạt động với OpenAI-compatible APIs, Gemini, GitHub Models, Codex, Ollama, Atomic Chat và các backend tương thích khác. Điều này có nghĩa là bạn có thể dùng cùng một giao diện CLI để chuyển qua lại giữa cloud model, local model và private gateway mà không phải thay đổi toàn bộ thói quen làm việc.

Những lợi thế kỹ thuật khiến Open Claude khác biệt

Một CLI cho cả cloud và local model

Nhiều đội ngũ kỹ thuật hiện phải chọn giữa hai thái cực: hoặc dùng dịch vụ cloud tiện lợi nhưng tốn chi phí và phụ thuộc vendor, hoặc dựng local model nhưng workflow rời rạc. Open Claude giải quyết điểm nghẽn đó bằng cách cho phép cùng một CLI chạy với OpenAI-compatible API, Ollama local, LM Studio, DeepSeek, Groq, Mistral, Azure OpenAI, OpenRouter, thậm chí cả Codex và GitHub Models. Với developer, đây là lợi ích lớn vì không phải học lại nhiều công cụ chỉ để đổi model.

Giữ nguyên workflow coding-agent thực thụ

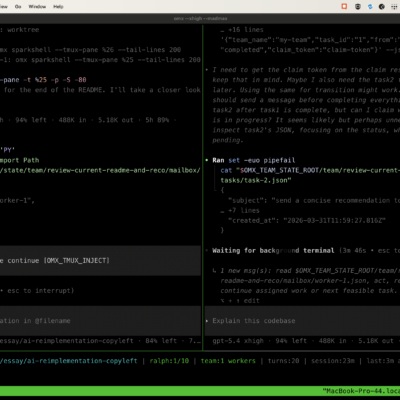

Open Claude không chỉ là wrapper gọi API chat. Repo xác nhận công cụ hỗ trợ các workflow điều khiển bằng tool như bash, file read/write/edit, grep, glob, agents, tasks, MCP, slash commands và streaming responses. Điều này biến nó thành một coding agent thực dụng hơn là một chatbot trong terminal.

Có cấu hình guided setup và profile lưu sẵn

Bên trong ứng dụng, bạn có thể dùng lệnh /provider để thiết lập profile cho OpenAI-compatible, Gemini, Ollama hoặc Codex; còn /onboard-github để cấu hình GitHub Models. Dự án cũng hỗ trợ lưu profile trong .openclaude-profile.json, rất hữu ích khi bạn phải chuyển đổi môi trường giữa laptop cá nhân, máy làm việc, CI box hoặc sandbox.

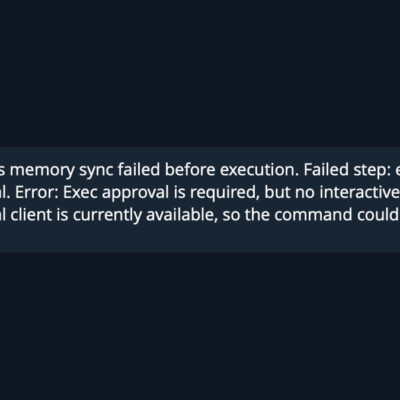

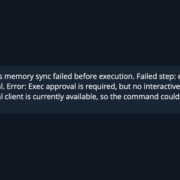

Trung thực về giới hạn chất lượng model

Tài liệu của Open Claude cũng nói khá thẳng: chất lượng tool calling phụ thuộc mạnh vào model được chọn; một số tính năng mang tính Anthropic-specific có thể không tồn tại ở provider khác; model local nhỏ có thể gặp khó khăn với các vòng tool flow dài nhiều bước; và một số provider có output cap thấp hơn mặc định của CLI. Đây là chi tiết quan trọng vì nó giúp người dùng đánh giá đúng hiệu năng thực tế thay vì kỳ vọng sai.

Hướng dẫn cài đặt Open Claude chi tiết

Yêu cầu môi trường

Trên macOS, Linux và Windows, tài liệu quick start yêu cầu Node.js 20 trở lên. Cài đặt cơ bản dùng npm, còn nếu build từ source thì dự án khuyến nghị Bun 1.3.11 trở lên cho một số trường hợp, đặc biệt khi làm việc từ source trên Windows. Ngoài ra, nếu sau khi cài mà terminal báo thiếu ripgrep, bạn cần cài rg ở cấp hệ thống và kiểm tra lại bằng rg --version.

Cài bằng npm

npm install -g @gitlawb/openclaude

openclaudeĐây là đường vào nhanh nhất để chạy công cụ. Sau khi khởi động, bạn có thể dùng /provider để cấu hình nhà cung cấp mô hình theo hướng dẫn tương tác ngay trong CLI.

Build từ source nếu bạn muốn kiểm soát nhiều hơn

git clone https://github.com/Gitlawb/openclaude.git

cd openclaude

bun install

bun run build

npm linkNếu muốn chạy trực tiếp ở chế độ phát triển, bạn cũng có thể dùng bun run dev. Đây là lựa chọn phù hợp cho kỹ sư AI hoặc contributor muốn quan sát runtime, sửa mã nguồn hoặc tích hợp thêm provider riêng.

Cấu hình provider cho các mô hình khác nhau

Cấu hình Ollama cho local model

Nếu bạn muốn chạy local để tiết kiệm chi phí hoặc giữ dữ liệu trong máy, Open Claude hỗ trợ Ollama qua giao diện OpenAI-compatible. Ví dụ cơ bản:

ollama pull llama3.1:8b

export CLAUDE_CODE_USE_OPENAI=1

export OPENAI_BASE_URL=http://localhost:11434/v1

export OPENAI_MODEL=llama3.1:8b

openclaudeTài liệu cũng nêu rõ rằng Ollama local không cần OPENAI_API_KEY. Đây là một lợi thế lớn với team muốn thử nghiệm coding agent mà chưa cần trả phí cloud ngay từ đầu.

Cấu hình DeepSeek qua cloud

Nếu bạn ưu tiên chi phí hợp lý nhưng vẫn muốn có mô hình mạnh hơn local nhỏ, DeepSeek là một lựa chọn đáng cân nhắc. Cấu hình mẫu:

export CLAUDE_CODE_USE_OPENAI=1

export OPENAI_API_KEY=sk-your-key-here

export OPENAI_BASE_URL=https://api.deepseek.com/v1

export OPENAI_MODEL=deepseek-chat

openclaudeVì Open Claude hỗ trợ lớp OpenAI-compatible provider, việc trỏ sang DeepSeek gần như chỉ là thay BASE_URL và MODEL, không cần đổi workflow CLI.

Cấu hình Gemini theo hướng linh hoạt

README ghi nhận Gemini được hỗ trợ qua /provider hoặc biến môi trường, còn tài liệu advanced setup minh họa một đường phổ biến là dùng Gemini qua OpenRouter với chuẩn OpenAI-compatible API:

export CLAUDE_CODE_USE_OPENAI=1

export OPENAI_API_KEY=sk-or-your-key

export OPENAI_BASE_URL=https://openrouter.ai/api/v1

export OPENAI_MODEL=google/gemini-2.0-flash-001

openclaudeCách tiếp cận này cho thấy triết lý của Open Claude: không ép người dùng theo một kênh duy nhất, mà dùng lớp tương thích để giúp nhiều model cùng đi qua một giao diện CLI thống nhất.

Cấu hình nhanh cho OpenAI hoặc provider tương thích OpenAI

export CLAUDE_CODE_USE_OPENAI=1

export OPENAI_API_KEY=sk-your-key-here

export OPENAI_MODEL=gpt-4o

openclaudeNgoài OpenAI, chính tài liệu dự án liệt kê OpenRouter, Groq, Mistral, LM Studio và nhiều server /v1 tương thích khác. Nếu hạ tầng nội bộ của bạn đã có OpenAI-compatible gateway, Open Claude đặc biệt phù hợp vì có thể tận dụng lại lớp API đó.

Cách dùng trong quy trình lập trình thực tế

Refactor code có kiểm soát

Sau khi chạy openclaude, bạn có thể yêu cầu agent phân tích module hiện tại, tìm code lặp, gợi ý tách hàm và sửa trực tiếp file. Vì công cụ hỗ trợ file tools, grep, glob, bash và streaming output, nó phù hợp cho những tác vụ refactor cần quan sát tiến trình theo từng bước. Về bản chất, đây là kiểu công việc mà một coding agent CLI làm tốt hơn giao diện chat thuần túy.

Ví dụ prompt thực dụng:

Phân tích thư mục src/, tìm các hàm xử lý lỗi bị lặp lại, đề xuất refactor và cập nhật code theo hướng giảm trùng lặp nhưng không đổi hành vi.Viết unit test nhanh hơn

Khi agent có thể đọc file, duyệt cấu trúc dự án và chỉnh sửa mã, bạn có thể yêu cầu nó sinh test cho một service hoặc module cụ thể, sau đó chạy test bằng shell. Đây là một trong những use case phù hợp nhất cho Open Claude vì vòng lặp model gọi tool, thực thi lệnh, đọc kết quả và chỉnh sửa tiếp đã được dự án xác nhận hỗ trợ.

Ví dụ prompt:

Đọc file services/payment.ts, tạo unit test cho các case thành công, timeout và invalid payload, sau đó chạy test và sửa nếu có lỗi.Gỡ bug theo vòng lặp nhiều bước

Open Claude đặc biệt hữu ích khi bạn đã có log lỗi hoặc stack trace. Thay vì chỉ hỏi “lỗi này là gì”, bạn có thể yêu cầu agent grep code liên quan, đọc file cấu hình, chạy lệnh tái hiện lỗi và vá trực tiếp. Chất lượng vẫn phụ thuộc vào model, nhưng kiến trúc CLI của Open Claude được xây cho đúng kiểu tác vụ đó.

Ví dụ prompt:

Đọc log lỗi trong logs/app.log, xác định nguyên nhân gây crash ở luồng đăng nhập, tái hiện lỗi nếu cần và đề xuất bản vá tối thiểu.Vì sao mã nguồn mở là lợi thế lớn hơn giải pháp đóng

Với giải pháp đóng, bạn thường bị khóa vào một vendor, một bộ model và một cách phân phối tính năng. Open Claude đi theo hướng ngược lại: mã nguồn mở, license MIT, hỗ trợ nhiều provider, có source build, có profile launcher, có diagnostics như doctor:runtime, smoke, hardening:check, và cho phép bạn thay backend theo mục tiêu coding, latency hay local-first. Với đội kỹ thuật, điều này quan trọng không chỉ về chi phí mà còn về khả năng kiểm soát, quan sát và mở rộng công cụ theo nhu cầu riêng.

Open Claude là một trong những dự án đáng chú ý nhất nếu bạn đang tìm coding agent CLI mã nguồn mở không bị ràng buộc vào một mô hình duy nhất. Giá trị lớn nhất của nó nằm ở chỗ giữ nguyên workflow terminal-first của coding agent, nhưng mở rộng backend sang cả cloud lẫn local model. Điều đó giúp lập trình viên, kỹ sư AI và team platform dễ thử nghiệm, tối ưu chi phí, tăng quyền kiểm soát hạ tầng và xây dựng một quy trình AI-assisted coding linh hoạt hơn. Nếu bạn cần một CLI AI vừa thực dụng vừa có khả năng tùy biến cao, Open Claude là lựa chọn rất đáng để cài thử ngay hôm nay.