Hướng dẫn chi tiết sử dụng model Gemma 4 của Google ngay trên điện thoại

Gemma 4 – model AI mã nguồn mở mạnh mẽ nhất từ Google DeepMind – vừa chính thức ra mắt ngày 2 tháng 4 năm 2026. Đây là gia đình model open-weight (Apache 2.0) được xây dựng từ công nghệ Gemini 3, hỗ trợ multimodal (văn bản + hình ảnh + âm thanh), reasoning nâng cao, agentic workflows (tự động thực hiện đa bước), context window lên đến 256K token, và đặc biệt tối ưu chạy hoàn toàn on-device trên smartphone.

Với các variant Gemma 4 E2B (Effective 2B) và E4B (Effective 4B), bạn có thể chạy AI siêu thông minh offline, bảo mật hoàn toàn, tốc độ nhanh, tiết kiệm pin ngay trên điện thoại mà không cần kết nối internet hay server đám mây.

Bài viết này sẽ hướng dẫn chi tiết từng bước cách sử dụng Gemma 4 trên smartphone (Android và iOS), từ dễ nhất đến nâng cao dành cho developer.

Tại sao Gemma 4 lại phù hợp với Smartphone?

- E2B & E4B: Thiết kế riêng cho mobile/edge devices (điện thoại, Raspberry Pi, laptop). Chạy offline với latency gần như bằng 0.

- Multimodal: Xử lý hình ảnh (OCR, chart, UI, handwriting), âm thanh (ASR + dịch thoại) trên model nhỏ.

- Thinking Mode + Agent Skills: Model tự suy nghĩ từng bước và gọi tool (tìm Wikipedia, vẽ map, tự động hóa tác vụ).

- Bảo mật & Riêng tư: Tất cả dữ liệu ở lại trên máy.

- Hỗ trợ: Hơn 140 ngôn ngữ (bao gồm tiếng Việt), function calling, coding, reasoning xuất sắc.

Model lớn hơn (26B MoE & 31B) phù hợp máy tính hơn, nhưng E2B/E4B là lựa chọn hoàn hảo cho điện thoại.

Yêu cầu thiết bị

- Android: Android 12 trở lên (API 31+). Hoạt động tốt trên flagship (Pixel 8+, Samsung Galaxy S24+, Xiaomi/OPPO cao cấp) nhờ GPU/NPU mạnh. Chạy được trên hơn 140 triệu thiết bị Android hiện nay.

- iOS: iOS 17 trở lên (iPhone 12 trở lên).

- RAM: Ít nhất 6–8 GB (tốt nhất 12 GB+ để chạy mượt).

- Lưu ý: Hiệu năng phụ thuộc phần cứng (CPU/GPU). Model E2B nhanh hơn, E4B thông minh hơn nhưng tốn tài nguyên hơn.

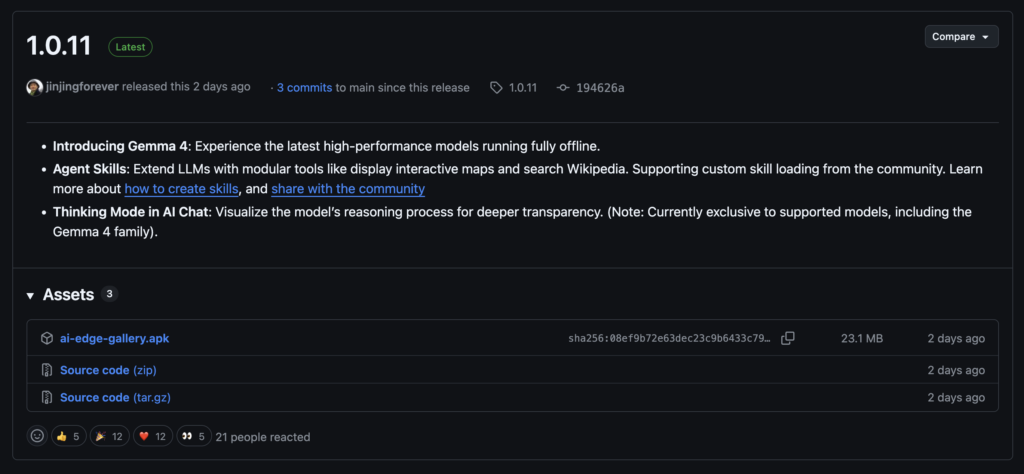

Cách dễ nhất: Sử dụng qua app Google AI Edge Gallery

Đây là app chính thức của Google, miễn phí, chạy 100% on-device, hỗ trợ Gemma 4 ngay từ ngày ra mắt. Không cần code, không cần tải model thủ công.

Bước 1: Tải và cài đặt app

- Android: Mở Google Play Store → Tìm “Google AI Edge Gallery” → Cài đặt.

Link tải trên Play Store: https://play.google.com/store/apps/details?id=com.google.ai.edge.gallery - iOS: Mở App Store → Tìm “Google AI Edge Gallery” → Cài đặt.

Link tải trên App Store: https://apps.apple.com/us/app/google-ai-edge-gallery/id6749645337 - Nếu không tìm thấy trên Store, tải APK mới nhất từ GitHub: github.com/google-ai-edge/gallery/releases.

Bước 2: Mở app và chọn model Gemma 4

- Mở app → Bạn sẽ thấy giao diện với các tile: AI Chat, Agent Skills, Ask Image, Prompt Lab, Model Management…

- Vào Model Management (hoặc tab Models).

- Tìm và tải Gemma 4 E2B hoặc E4B (app sẽ tự động gợi ý model phù hợp với máy bạn).

- Chờ tải xong (khoảng 1–3 GB tùy model, chỉ tải 1 lần).

Bước 3: Sử dụng các tính năng chính

- AI Chat + Thinking Mode (tính năng nổi bật của Gemma 4):

- Chọn tile AI Chat.

- Bật Thinking Mode (nếu có) → Model sẽ hiển thị suy nghĩ từng bước (rất hữu ích cho toán học, lập kế hoạch, coding).

- Hỏi bất kỳ gì bằng tiếng Việt: “Viết email xin nghỉ phép”, “Phân tích bức ảnh này”, “Lập kế hoạch du lịch Đà Lạt 3 ngày”…

- Agent Skills (tự động đa bước):

- Chọn Agent Skills.

- Model có thể gọi tool (tìm Wikipedia, hiển thị map, tạo visual card…).

- Ví dụ: “Tìm thông tin về Hà Nội và vẽ bản đồ các địa điểm nổi tiếng”.

- Ask Image: Chụp ảnh hoặc chọn từ thư viện → Gemma 4 phân tích (OCR, mô tả chi tiết, giải thích chart…).

- Prompt Lab: Thử prompt nâng cao, chỉnh temperature, top-k.

- Benchmark: Đo tốc độ model trên máy bạn.

Mẹo: Lần đầu chạy có thể hơi chậm (warm-up), sau đó rất mượt. App hỗ trợ load custom model nếu bạn muốn thử GGUF từ Hugging Face.

Cách nâng cao cho Developer (Tích hợp Gemma 4 vào app của bạn)

Nếu bạn là lập trình viên Android:

- Sử dụng AICore Developer Preview (hệ thống Gemma 4 built-in trên Android).

- Tích hợp qua ML Kit GenAI Prompt API hoặc MediaPipe LLM Inference API.

- Code ví dụ đơn giản:

// Sử dụng ML Kit GenAI

val prompt = Prompt("Giải thích bức ảnh này")

val response = genAiClient.generateContent(prompt) // Chạy on-device với Gemma 4Chi tiết docs: developers.google.com/ml-kit/genai và ai.google.dev/edge.

Bạn cũng có thể dùng Google AI Edge (LiteRT-LM) để build trải nghiệm agentic cross-platform (Android + iOS).

Lưu ý quan trọng & Mẹo tối ưu

- Offline 100%: Không cần mạng sau khi tải model.

- Pin & Nhiệt: Model nhỏ nên tiết kiệm pin, nhưng dùng lâu có thể nóng máy (bình thường).

- Cập nhật: App và model sẽ được Google cập nhật thường xuyên.

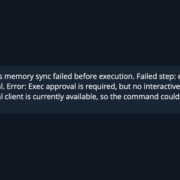

- Third-party: Nếu muốn chạy qua Ollama mobile hoặc llama.cpp (GGUF), có thể thử trên Android với Termux hoặc app như LM Studio (hiện chủ yếu desktop). Tuy nhiên Google AI Edge Gallery là cách ổn định và tối ưu nhất.

- Ngôn ngữ: Hỗ trợ tiếng Việt rất tốt ngay từ đầu.

Gemma 4 đánh dấu bước ngoặt lớn: AI frontier-level giờ đây chạy ngay trong túi quần của bạn, hoàn toàn riêng tư và miễn phí. Với Google AI Edge Gallery, bất kỳ ai cũng có thể trải nghiệm ngay hôm nay mà không cần kiến thức lập trình.

Bạn đã thử Gemma 4 trên điện thoại chưa? Model nào (E2B hay E4B) chạy mượt nhất trên máy bạn? Comment bên dưới chia sẻ trải nghiệm nhé!