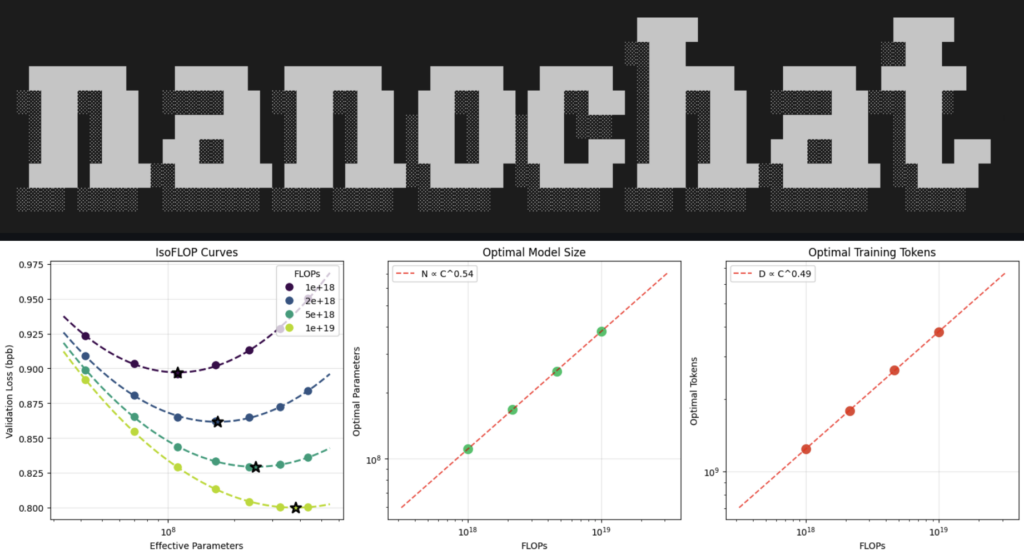

nanochat: khung thử nghiệm đơn giản nhất để huấn luyện mô hình AI

Tóm tắt nhanh

- Nanochat là experimental harness tối giản, hackable, chạy trên single GPU node và bao quát toàn bộ vòng đời LLM: tokenization, pretraining, finetuning (SFT + RL), evaluation, inference và chat UI kiểu ChatGPT.

- Chỉ một tham số –depth quyết định toàn bộ mô hình (width, heads, learning rate, training horizon, weight decay) để luôn compute-optimal; GPT-2-grade đạt được ở depth khoảng 24-26.

- Huấn luyện mô hình GPT-2-grade chỉ tốn khoảng 48 USD trên 8x H100 (2-3 giờ) hoặc ~15 USD trên spot instance, với leaderboard time-to-GPT-2.

- Khác biệt hoàn toàn với nanoGPT (chỉ pretraining) hay Hugging Face: thuần PyTorch, không config khổng lồ, dễ fork và nghiên cứu micro-scale LLM.

- Phù hợp cho lập trình viên muốn tự xây dựng chatbot từ đầu trên phần cứng hạn chế, với tốc độ huấn luyện nhanh và giao diện web sẵn dùng.

Tại sao nanochat lại ra đời

Nanochat ra đời từ triết lý của Andrej Karpathy: biến việc huấn luyện LLM quy mô nhỏ trở nên dễ tiếp cận, rẻ tiền và dễ hiểu nhất có thể. Trong khi các framework hiện đại ngày càng phức tạp với hàng trăm tùy chọn cấu hình, thư viện phụ thuộc khổng lồ và yêu cầu cụm GPU lớn, nanochat được thiết kế như một experimental harness thuần túy.

Karpathy nhấn mạnh đây không phải là một thư viện đa năng với model factory hay config object khổng lồ. Thay vào đó, nó là codebase sạch sẽ, tối giản, dễ đọc, dễ sửa và cực kỳ dễ fork. Mục tiêu chính là giúp bất kỳ ai với ngân sách dưới 1000 USD cũng có thể huấn luyện được mô hình tương đương GPT-2 (tốn 43.000 USD năm 2019) chỉ với khoảng 48 USD và trò chuyện ngay qua giao diện web quen thuộc.

Triết lý cốt lõi nằm ở việc giảm thiểu cognitive overhead. Người dùng chỉ cần điều chỉnh một nút vặn duy nhất là --depth (số layer transformer). Toàn bộ hyper-parameter còn lại được tính toán tự động để mô hình luôn nằm ở điểm compute-optimal. Kết quả là một miniseries mô hình mạnh mẽ, có thể chạy end-to-end và tạo ra chatbot thực sự hữu dụng.

Phân tích kiến trúc tối giản của repo

Thiết kế depth-only scaling

Kiến trúc nanochat xoay quanh ý tưởng đơn giản: chỉ thay đổi --depth là đủ scale toàn bộ mô hình. Depth khoảng 24-26 cho khả năng GPT-2-grade. Width, số attention head, learning rate, training horizon và weight decay đều được tính toán tự động dựa trên depth. Điều này loại bỏ hoàn toàn việc tuning thủ công phức tạp thường gặp ở các codebase khác.

Cấu trúc thư mục và module chính

Repo được tổ chức gọn gàng với các module thuần PyTorch:

nanochat/gpt.pychứa định nghĩa Transformer (GPT) hoàn chỉnh.nanochat/optim.pytriển khai AdamW kết hợp Muon optimizer, hỗ trợ single-GPU và distributed training.nanochat/dataloader.pyvà nanochat/dataset.py xử lý tokenization và tải dữ liệu pre-training (Parquet shards).nanochat/engine.pyquản lý KV-cache inference nhanh chóng.nanochat/core_eval.pyvà nanochat/loss_eval.py cung cấp benchmark DCLM CORE cùng bits-per-byte evaluation.scripts/chứa entry point CLI: base_train.py (pretraining), chat_sft.py, chat_rl.py, chat_web.py, chat_cli.py.runs/chứa speedrun.sh, runcpu.sh, miniseries.sh và scaling_laws.sh.

Toàn bộ codebase giữ mức tối thiểu, không dùng torch.autocast mà quản lý mixed-precision thủ công qua biến môi trường NANOCHAT_DTYPE (bfloat16 hoặc float32). Thiết kế này tăng tốc và dễ debug hơn nhiều.

Sự khác biệt so với các framework khác

So với nanoGPT (chỉ pretraining) hay Hugging Face Transformers, nanochat loại bỏ hoàn toàn các lớp config phức tạp và model factory. Nó không cố gắng trở thành thư viện đa năng mà tập trung làm một strong baseline cho GPT-style full-stack. Kết quả là tốc độ phát triển nhanh hơn, chi phí thấp hơn và khả năng tùy chỉnh cao hơn. Bạn có thể chỉnh sửa bất kỳ phần nào chỉ trong vài dòng code mà không sợ phá vỡ hệ thống.

Hướng dẫn cài đặt môi trường python và thư viện phụ thuộc

Quá trình cài đặt cực kỳ đơn giản. Bắt đầu bằng clone repository:

git clone https://github.com/karpathy/nanochat.git

cd nanochatNanochat sử dụng uv để quản lý môi trường nhanh chóng:

uv sync

source .venv/bin/activateHệ thống tự động cài đặt PyTorch phù hợp với GPU hoặc CPU. Các phụ thuộc chỉ giới hạn ở PyTorch và một số tiện ích nhỏ, không cần Hugging Face hay Accelerate. Nếu muốn theo dõi qua Weights & Biases, đăng nhập wandb một lần. Toàn bộ cài đặt thường mất dưới 5 phút.

Quy trình huấn luyện một mô hình demo

Nanochat cung cấp nhiều mức độ huấn luyện. Cách nhanh nhất để có mô hình demo là chạy speedrun:

bash runs/speedrun.shScript này huấn luyện mô hình depth khoảng 24 trên 8x H100 trong khoảng 2-3 giờ, sau đó bạn có thể khởi động giao diện web:

python -m scripts.chat_webMở URL được in ra (thường http://:8000) để trò chuyện với mô hình ChatGPT-style.

Để thử nghiệm nhanh trên máy cá nhân, dùng script CPU/MPS:

bash runs/runcpu.shHoặc chạy mô hình nhỏ depth 12 trong vài phút:

OMP_NUM_THREADS=1 torchrun --standalone --nproc_per_node=8 -m scripts.base_train -- \

--depth=12 \

--run="d12" \

--model-tag="d12" \

--core-metric-every=999999 \

--sample-every=-1 \

--save-every=-1Sau pretraining, tiếp tục fine-tuning với chat_sft.py (supervised) hoặc chat_rl.py (reinforcement). Toàn bộ pipeline từ dữ liệu thô đến chatbot sẵn dùng nằm trong một repo duy nhất.

Cách tinh chỉnh các tham số

Mặc dù nanochat tự động hóa cao, vẫn có vài nút vặn quan trọng. Tham số chính là –depth: tăng để có mô hình mạnh hơn (24-26 cho GPT-2-grade). Nếu VRAM hạn chế, giảm –device_batch_size (mặc định 32, thử 16 hoặc 8).

Để thay đổi độ chính xác, set biến môi trường:

export NANOCHAT_DTYPE=bfloat16Bạn cũng có thể chỉnh số bước huấn luyện, tần suất checkpoint hoặc tắt một số evaluation để tăng tốc. Đối với lập trình viên muốn đi sâu, mở nanochat/optim.py hoặc nanochat/gpt.py để chỉnh optimizer, attention hay thêm module mới. Codebase nhỏ và rõ ràng nên tùy chỉnh không gây rối loạn.

Nanochat hỗ trợ đánh giá trên nhiều task chuẩn như ARC, GSM8K, MMLU, HumanEval giúp đo lường chính xác tiến bộ mô hình.

Với nanochat, bất kỳ ai cũng có thể tự huấn luyện mô hình ngôn ngữ lớn hữu dụng mà không cần ngân sách lớn hay kiến thức hệ thống phân tán. Đây là công cụ lý tưởng để học sâu machine learning, thử nghiệm ý tưởng và xây dựng chatbot cá nhân từ con số không. Repo mã nguồn mở này đang chờ bạn fork và biến thành phiên bản riêng. Bắt đầu ngay hôm nay để khám phá sức mạnh thực sự của huấn luyện LLM theo cách đơn giản nhất.