DeerFlow 2.0 – Super agent harness mã nguồn mở từ ByteDance

Tóm tắt nhanh (Key Takeaways)

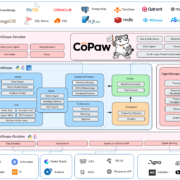

DeerFlow 2.0 là một super agent harness mã nguồn mở do ByteDance phát triển, được viết lại hoàn toàn từ đầu so với phiên bản 1.x. Thay vì chỉ là một công cụ nghiên cứu, DeerFlow 2.0 là một hạ tầng thực thi đầy đủ: agent có sandbox riêng với filesystem, bộ nhớ dài hạn xuyên phiên, hệ thống skill có thể mở rộng, và khả năng tạo cùng điều phối các sub-agent chạy song song. Được xây dựng trên LangGraph và LangChain, DeerFlow hỗ trợ mọi mô hình ngôn ngữ tương thích OpenAI API và cung cấp cả giao diện web lẫn Python client nhúng. Ngày 28 tháng 2 năm 2026, DeerFlow 2.0 đứng số 1 GitHub Trending toàn cầu ngay sau khi ra mắt.

DeerFlow là gì?

DeerFlow, viết tắt của Deep Exploration and Efficient Research Flow, là một super agent harness mã nguồn mở do ByteDance phát triển. Dự án được công bố tại github.com/bytedance/deer-flow và được cấp phép MIT, tức là hoàn toàn miễn phí cho cả mục đích cá nhân lẫn thương mại.

Điểm quan trọng cần nắm ngay: DeerFlow 2.0 là một bản viết lại hoàn toàn, không dùng chung một dòng code nào với phiên bản 1.x. Phiên bản cũ là một deep research framework; phiên bản 2.0 là một hạ tầng thực thi tổng quát, nơi agent có thể nghiên cứu, viết code, tạo slide, xây dựng website, sinh video và hình ảnh, tất cả trong một vòng thực thi tự động.

Điều gì khiến DeerFlow khác với các AI Agent thông thường?

Hầu hết các AI agent hiện tại hoạt động như một chatbot có thêm tool: nhận yêu cầu, gọi API, trả về văn bản. DeerFlow tiếp cận vấn đề theo hướng khác, cung cấp cho agent một môi trường máy tính thực sự.

Agent có máy tính riêng

Mỗi tác vụ trong DeerFlow chạy bên trong một Docker container cô lập với filesystem đầy đủ. Agent có thể đọc và ghi file, thực thi lệnh bash, chạy code Python, xem hình ảnh và quản lý output. Đây là sự khác biệt cơ bản giữa một chatbot có quyền gọi tool và một agent có môi trường thực thi thực sự.

Sub-Agent song song

Các tác vụ phức tạp thường không thể hoàn thành trong một lần xử lý tuyến tính. DeerFlow cho phép agent chính tạo và điều phối các sub-agent theo thời gian thực. Mỗi sub-agent có context riêng biệt, bộ công cụ riêng và điều kiện kết thúc riêng. Các sub-agent có thể chạy song song, báo cáo kết quả có cấu trúc về cho agent chính để tổng hợp thành output cuối cùng. Đây là cơ chế giúp DeerFlow xử lý được các tác vụ kéo dài từ vài phút đến vài giờ.

Bộ nhớ dài hạn xuyên phiên

Hầu hết các AI agent quên mọi thứ khi kết thúc conversation. DeerFlow xây dựng bộ nhớ dai dẳng qua các phiên làm việc, bao gồm hồ sơ người dùng, sở thích cá nhân, và kiến thức tích lũy. Toàn bộ dữ liệu được lưu trữ cục bộ và nằm hoàn toàn trong tầm kiểm soát của người dùng.

Các thành phần cốt lõi

Skills: Khả năng có thể mở rộng

Skills là đơn vị mô tả năng lực của DeerFlow. Mỗi skill là một file Markdown định nghĩa workflow, best practice và tài nguyên hỗ trợ. DeerFlow đi kèm với bộ skill tích hợp cho nghiên cứu, tạo báo cáo, tạo slide, xây dựng trang web, sinh hình ảnh và video. Skills được nạp theo từng tác vụ, không phải tất cả cùng lúc, giúp context window luôn gọn gàng.

/mnt/skills/public

research/SKILL.md

report-generation/SKILL.md

slide-creation/SKILL.md

web-page/SKILL.md

image-generation/SKILL.md

/mnt/skills/custom

your-custom-skill/SKILL.mdTools và MCP Server

Bộ công cụ mặc định bao gồm web search, web fetch, thao tác file và thực thi bash. DeerFlow hỗ trợ mở rộng công cụ thông qua MCP (Model Context Protocol) servers và Python functions. Các HTTP/SSE MCP server với OAuth token flow cũng được hỗ trợ đầy đủ.

Context Engineering

DeerFlow quản lý context chủ động: tóm tắt các sub-task đã hoàn thành, chuyển kết quả trung gian xuống filesystem, nén những phần không còn cần thiết. Đây là cơ chế giúp agent duy trì hiệu suất ổn định trên các tác vụ dài, đa bước mà không bị tràn context window.

Hướng dẫn cài đặt

Yêu cầu hệ thống

- Docker và Docker Compose (cho phương pháp Docker)

- Hoặc: Node.js 22+, pnpm, uv, nginx (cho phương pháp local)

- API key của ít nhất một LLM provider (OpenAI, DeepSeek, Gemini, Doubao, v.v.)

- Tavily API key (cho web search, có gói miễn phí)

Bước 1: Clone Repository và tạo cấu hình

git clone https://github.com/bytedance/deer-flow.git

cd deer-flow

make configLệnh make config tạo ra các file cấu hình từ template mẫu, bao gồm config.yaml và .env.

Bước 2: Cấu hình model

Chỉnh sửa config.yaml để định nghĩa model muốn sử dụng:

models:

- name: gpt-5.3-codex

display_name: GPT-5.3-Codex

use: langchain_openai:ChatOpenAI

model: gpt-5.3-codex

api_key: $OPENAI_API_KEY

max_tokens: 1000000

temperature: 0.7DeerFlow hỗ trợ bất kỳ mô hình nào tương thích với OpenAI API. Để dùng DeepSeek hay Gemini, chỉ cần thay đổi class LangChain tương ứng và API key.

Bước 3: Thiết lập API Keys

Chỉnh sửa file .env tại thư mục gốc:

TAVILY_API_KEY=your-tavily-api-key

OPENAI_API_KEY=your-openai-api-keyBước 4: Khởi động ứng dụng

Phương pháp Docker (khuyến nghị):

make docker-init # Tải sandbox image về (chỉ cần làm một lần)

make docker-start # Khởi động toàn bộ servicesPhương pháp Local Development:

make check # Kiểm tra prerequisites

make install # Cài đặt dependencies frontend và backend

make dev # Khởi động servicesSau khi khởi động, truy cập giao diện web tại http://localhost:2026.

Sử dụng DeerFlow qua Python Client

Ngoài giao diện web, DeerFlow cung cấp Python client nhúng để tích hợp trực tiếp vào code mà không cần chạy HTTP server:

from src.client import DeerFlowClient

client = DeerFlowClient()

# Chat đơn giản

response = client.chat("Phân tích bài báo này cho tôi", thread_id="my-thread")

# Streaming

for event in client.stream("Viết báo cáo về thị trường AI năm 2025"):

if event.type == "messages-tuple" and event.data.get("type") == "ai":

print(event.data["content"])

# Quản lý cấu hình

models = client.list_models()

skills = client.list_skills()

client.update_skill("web-search", enabled=True)

client.upload_files("thread-1", ["./report.pdf"])Các model được khuyến nghị

DeerFlow không phụ thuộc vào một nhà cung cấp model cụ thể, nhưng hoạt động tốt nhất với các model có:

- Context window dài (100k+ token) cho nghiên cứu chuyên sâu và tác vụ đa bước

- Khả năng reasoning mạnh để lập kế hoạch và phân rã vấn đề phức tạp

- Hỗ trợ multimodal để xử lý hình ảnh và video

- Tool-use đáng tin cậy cho function calling và structured output

Các model đã được cộng đồng kiểm chứng: GPT-4o, Claude 3.5/3.7 Sonnet, DeepSeek R1/V3, Gemini 2.0 Flash, Doubao.

Các chế độ Sandbox

DeerFlow hỗ trợ ba chế độ thực thi sandbox:

- Local Execution: Chạy code sandbox trực tiếp trên máy host, phù hợp cho môi trường phát triển cá nhân.

- Docker Execution: Chạy code trong Docker container cô lập, đảm bảo an toàn và không ảnh hưởng đến hệ thống host.

- Docker + Kubernetes: Dành cho triển khai quy mô lớn, chạy sandbox trong Kubernetes pods thông qua provisioner service.

DeerFlow 2.0 đánh dấu sự trưởng thành của một thế hệ AI agent mới: không chỉ trả lời câu hỏi mà thực sự thực thi tác vụ trong một môi trường có đầy đủ hạ tầng. Với sandbox cô lập, bộ nhớ dài hạn, sub-agent song song, hệ thống skill mở rộng và tích hợp MCP, DeerFlow là nền tảng phù hợp cho bất kỳ ai muốn xây dựng các quy trình tự động hóa phức tạp mà không bị ràng buộc bởi giới hạn của các dịch vụ AI thương mại.

Dự án đang phát triển rất tích cực với sự hỗ trợ của cộng đồng mã nguồn mở ngày càng lớn. Đây là thời điểm tốt để bắt đầu thử nghiệm và nghiên cứu về nó.

- Mã nguồn: github.com/bytedance/deer-flow

- Trang chủ và demo: deerflow.tech

- Tài liệu cấu hình: Configuration Guide

- Giấy phép: MIT License