Tóm tắt nhanh

- AutoGPT là một nền tảng để tạo, triển khai và vận hành các AI Agent chạy liên tục, được phát triển bởi Significant Gravitas.

- Dự án hiện có hai lớp đáng chú ý: nền tảng AutoGPT Platform cho continuous agents và hệ sinh thái “Classic” từng làm AutoGPT nổi tiếng với mô hình agent tự suy nghĩ rồi tự hành động.

- Về mặt vận hành, AutoGPT kết hợp vòng lặp suy luận, khả năng gọi công cụ, truy cập dữ liệu bên ngoài, ghi nhớ ngữ cảnh và triển khai workflow tự động qua server/frontend.

- Bạn có thể self-host bằng script một dòng, Docker Compose, hoặc chạy backend/frontend riêng cho môi trường phát triển với Python, Poetry, Node.js và pnpm.

- AutoGPT đặc biệt phù hợp cho các tác vụ như nghiên cứu thị trường, tạo nội dung, xử lý dữ liệu, xây dựng agent nội bộ và tự động hóa quy trình doanh nghiệp.

Tầm nhìn của AutoGPT về AI cho mọi người

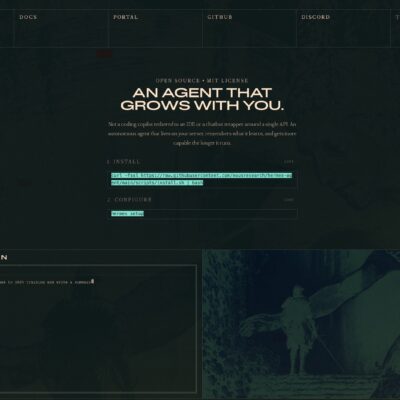

Điều khiến AutoGPT trở thành một cột mốc trong lịch sử AI Agent không chỉ là độ nổi tiếng của dự án, mà còn là tuyên ngôn rất rõ ràng: “AI dễ tiếp cận cho mọi người, để sử dụng và để xây dựng tiếp”. Trên GitHub, dự án mô tả sứ mệnh của mình là cung cấp công cụ để người dùng tập trung vào ba việc quan trọng hơn: xây dựng, kiểm thử và giao việc cho AI. Trên trang chủ agpt.co, AutoGPT cũng được định vị như một nền tảng giúp con người dành nhiều thời gian hơn cho công việc sáng tạo và có tác động lớn, thay vì bị mắc kẹt trong những quy trình số lặp đi lặp lại.

Nếu nhìn dưới góc độ SEO và GEO, đây là điểm then chốt để hiểu AutoGPT: nó không chỉ là một chatbot biết trả lời, mà là một framework AI Agent tự trị hướng đến tự động hóa workflow phức tạp. Tài liệu chính thức mô tả AutoGPT Platform như một hệ thống cho phép tạo, triển khai và quản lý các continuous agents có thể hoạt động liên tục, kích hoạt bởi các nguồn bên ngoài, theo dõi được vòng đời chạy, và tái sử dụng qua các workflow low-code dựa trên block.

Cách AutoGPT hoạt động: từ mục tiêu đến chuỗi hành động tự trị

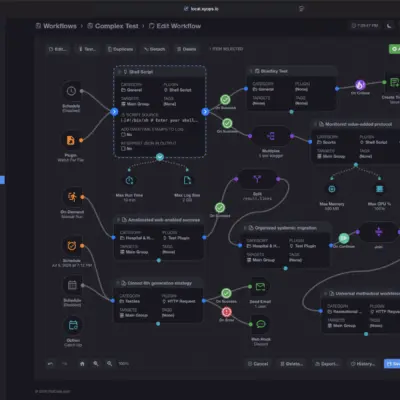

Về mặt kiến trúc hiện đại, AutoGPT được tách thành hai phần lớn: Frontend và Server. Frontend là nơi người dùng xây dựng agent, ghép các block, quản lý workflow, chọn agent dựng sẵn và chạy thử. Server là nơi agent thực sự chạy, xử lý logic lõi, thực thi automation và cho phép agent được kích hoạt liên tục bởi các trigger bên ngoài. Cách tách lớp này biến AutoGPT từ một thử nghiệm agent đơn lẻ thành một nền tảng AI automation có thể self-host và mở rộng.

Vòng lặp “tự suy nghĩ” nổi tiếng của AutoGPT Classic

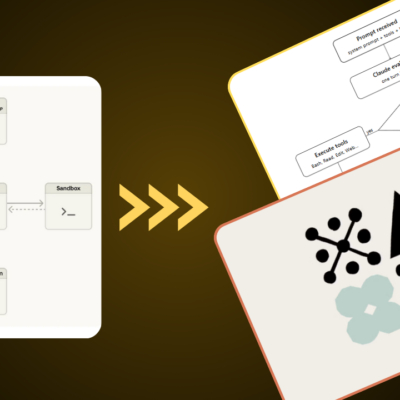

Trong cộng đồng mã nguồn mở, AutoGPT nổi lên nhờ hình mẫu agent tự vận hành theo chuỗi tư duy mà nhiều người biết đến dưới dạng Thought -> Reasoning -> Plan -> Criticism. Các log công khai của AutoGPT Classic cho thấy agent thường xuất ra các trường như THOUGHTS, REASONING, PLAN, CRITICISM, sau đó mới quyết định NEXT ACTION và tham số lệnh. Đây chính là cơ chế “tự suy nghĩ” đã khiến AutoGPT trở thành biểu tượng ban đầu của Autonomous AI Agent.

Hiểu đơn giản, vòng lặp này hoạt động như sau. “Thought” là agent tự diễn giải nó đang cố làm gì. “Reasoning” là lý do tại sao hành động tiếp theo hợp lý. “Plan” là danh sách các bước dự kiến. “Criticism” là lớp tự phản biện để phát hiện rủi ro, thiếu sót hoặc hướng đi sai. Sau đó agent mới chọn công cụ phù hợp để thực thi. Dù AutoGPT Platform ngày nay thiên về workflow-based automation hơn, tinh thần cốt lõi của AutoGPT vẫn là để mô hình không chỉ trả lời mà còn tự phân tích, tự lập kế hoạch và tự tiến về mục tiêu.

Truy cập web, sử dụng tools và tác vụ ngoài mô hình

Một AI Agent chỉ thật sự hữu ích khi nó không bị giới hạn trong khung chat. AutoGPT Classic từng nổi tiếng với các lệnh như browse_website và search_files, cho thấy agent có thể truy cập website, thu thập dữ liệu và dùng công cụ để tiếp tục nhiệm vụ thay vì chỉ sinh văn bản thuần túy. Trong log lỗi công khai, chính các command này xuất hiện như bước hành động kế tiếp mà agent tự chọn sau phần THOUGHTS/REASONING/PLAN.

Ở phiên bản Platform, khái niệm “tools” được khái quát hóa bằng blocks. Tài liệu mô tả block là các đơn vị hành động trong workflow, có thể là kết nối dịch vụ bên ngoài, công cụ xử lý dữ liệu, mô hình AI, script tùy chỉnh hoặc logic điều kiện. Điều này có nghĩa là AutoGPT hiện đại không bó hẹp ở một bộ lệnh cố định, mà cho phép xây agent bằng cách ghép các hành động chuyên biệt thành một pipeline tự động hóa hoàn chỉnh.

Bộ nhớ ngắn hạn và dài hạn trong thực tế vận hành

Một điểm rất đặc trưng của AutoGPT là tư duy “bộ nhớ ngắn hạn có giới hạn, nên thông tin quan trọng phải được lưu lại”. Trong một issue công khai của dự án, prompt ràng buộc của agent ghi rõ rằng short-term memory chỉ khoảng 4.000 từ và agent nên lập tức lưu thông tin quan trọng vào file; khi cần nhớ lại việc cũ, nó phải dựa vào các dấu vết đã lưu hoặc các sự kiện tương tự để hồi tưởng. Đây là mô hình bộ nhớ thực dụng: ngữ cảnh ngắn hạn cho lượt suy luận hiện tại, cộng với bộ nhớ bền hơn qua file hoặc hệ thống lưu trữ ngoài.

Từ góc nhìn kiến trúc, AutoGPT Platform đưa ý tưởng đó lên mức hệ thống hơn. Agent chạy liên tục trên server, quản lý workflow, có monitoring và analytics, đồng thời có thể dùng block để kết nối với dữ liệu, công cụ và nguồn ngoài. Nói cách khác, “trí nhớ” của AutoGPT hiện đại không chỉ là context window của LLM, mà còn là khả năng lưu trạng thái quy trình, gọi lại dữ liệu và tiếp tục công việc qua các lần kích hoạt.

Hướng dẫn cài đặt AutoGPT chi tiết

Yêu cầu hệ thống

Nếu bạn muốn self-host AutoGPT, repository chính thức khuyến nghị cấu hình tối thiểu khá rõ: CPU từ 4 core trở lên, RAM tối thiểu 8 GB và nên có 16 GB, cùng ít nhất 10 GB dung lượng trống. Về phần mềm, tài liệu liệt kê Linux, macOS hoặc Windows 10/11 với WSL2, cùng Docker Engine, Docker Compose, Git, Node.js, npm và một editor hiện đại như VSCode. Đây là tín hiệu rõ rằng AutoGPT đã vượt ra khỏi phạm vi “một script Python nhỏ” để trở thành một stack ứng dụng đầy đủ.

Cài đặt nhanh bằng script tự động

Cách dễ nhất để chạy AutoGPT cục bộ là dùng script chính thức. Đây là phương án được repo khuyến nghị cho local hosting vì script sẽ kéo dependency, cấu hình Docker và khởi chạy instance địa phương nhanh chóng.

# macOS / Linux

curl -fsSL https://setup.agpt.co/install.sh -o install.sh && bash install.sh# Windows PowerShell

powershell -c "iwr https://setup.agpt.co/install.bat -o install.bat; ./install.bat"Cài đặt thủ công bằng Docker Compose

Nếu muốn hiểu rõ hơn quy trình hoặc kiểm soát môi trường self-hosted, bạn có thể cài đặt thủ công. Tài liệu getting started hướng dẫn clone repo, đi vào thư mục autogpt_platform, sao chép .env.default thành .env, rồi chạy Docker Compose để dựng toàn bộ dịch vụ. Sau đó, frontend mặc định chạy ở cổng 3000, backend websocket ở 8001 và execution API ở 8006.

git clone https://github.com/Significant-Gravitas/AutoGPT.git

cd AutoGPT/autogpt_platform

cp .env.default .env

docker compose up -d --buildThiết lập môi trường Python cho backend

Với kỹ sư muốn phát triển hoặc tùy biến sâu phần backend, tài liệu chính thức yêu cầu Python 3.10 trở lên và Poetry để quản lý dependency. Quy trình chuẩn là khởi động các service phụ trợ trước, đi vào thư mục backend, cài dependency bằng Poetry rồi chạy server ứng dụng. Cách này phù hợp nếu bạn định thêm block mới, sửa logic agent hoặc tích hợp AutoGPT vào hệ thống nội bộ của doanh nghiệp.

make start-core

cd backend

poetry install --with dev

poetry run appCấu hình API keys và biến môi trường

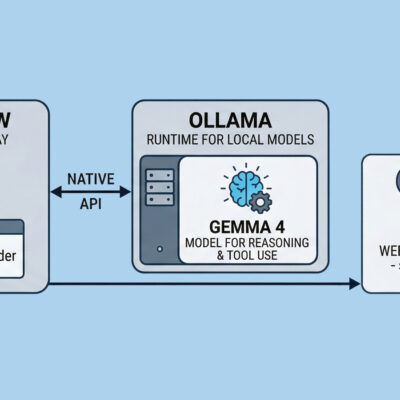

Tài liệu self-hosting nêu rõ một bước bắt buộc là sao chép .env.default thành .env rồi chỉnh các biến môi trường theo nhu cầu của bạn. Ngoài ra, docs của AutoGPT Platform cũng cho biết nền tảng đã pre-integrate với AI/ML API, nhà cung cấp hơn 300 mô hình như DeepSeek, Gemini và ChatGPT. Trên thực tế, điều này có nghĩa là trước khi chạy tác vụ thực, bạn cần điền khóa API của nhà cung cấp LLM hoặc dịch vụ bạn dùng vào file .env, đồng thời cân nhắc đổi encryption key ở backend để bảo vệ dữ liệu cục bộ.

Nếu bạn triển khai cho đội ngũ hoặc doanh nghiệp, nên xem file .env như một phần của quy trình vận hành: tách môi trường dev/staging/prod, quản lý secret bằng vault hoặc CI/CD secret manager, và không commit khóa thật lên Git. AutoGPT hỗ trợ mô hình self-hosted, nên bạn có lợi thế lớn về kiểm soát hạ tầng, cấu hình mạng và cách agent truy cập các API bên ngoài.

Bắt đầu nhiệm vụ đầu tiên với AutoGPT

Sau khi các service chạy xong, bạn mở giao diện frontend tại http://localhost:3000. Từ đây, bạn có thể chọn một agent dựng sẵn hoặc dùng Agent Builder để ghép workflow bằng block. GitHub README nhấn mạnh rằng frontend là nơi chạy agent, tương tác với agent và theo dõi monitoring/analytics, trong khi docs chính thức xem agent như một workflow tự động được tạo từ các action block.

Một số nhiệm vụ thực tế mà AutoGPT đặc biệt phù hợp gồm: nghiên cứu thị trường và prospecting cho sales, tạo nội dung marketing quy mô lớn, phân tích dữ liệu khách hàng để tối ưu chiến dịch, hoặc xây dựng quy trình AI nội bộ cho xử lý dữ liệu và thông báo tự động. Trang chủ agpt.co còn mô tả các ví dụ điển hình như agent đọc xu hướng Reddit để tạo video ngắn, hoặc agent theo dõi kênh YouTube rồi tự trích quote nổi bật để đăng mạng xã hội.

Nếu bạn mới bắt đầu, cách tốt nhất là giao cho AutoGPT một mục tiêu hẹp, đo lường được và có đầu ra rõ ràng, chẳng hạn: “Thu thập 20 đối thủ trong ngách X và tóm tắt USP của họ”, hoặc “Tạo workflow tổng hợp lead mới từ email và ghi sang CRM”. Với AutoGPT, bí quyết không nằm ở việc viết prompt hoa mỹ, mà ở chỗ chia nhiệm vụ đúng mức, cấp đúng tools và ràng buộc hợp lý để agent không rơi vào loop vô ích.

Vì sao AutoGPT vẫn quan trọng trong kỷ nguyên AI Agent

Ngày nay có rất nhiều framework AI Agent mới, nhưng AutoGPT vẫn giữ vị trí đặc biệt vì nó là một trong những dự án đầu tiên biến ý tưởng “LLM tự lập kế hoạch và tự hành động” thành một phong trào toàn cầu. Kho mã nguồn của dự án hiện vừa duy trì di sản AutoGPT Classic dưới giấy phép MIT, vừa mở rộng sang AutoGPT Platform với frontend, server, marketplace và workflow builder. Với lập trình viên, đây là một cơ sở tốt để học cách agent vận hành. Với doanh nghiệp, đây là một lựa chọn self-hosted đáng chú ý cho tự động hóa AI. Với cộng đồng mã nguồn mở, AutoGPT vẫn là một cột mốc chiến lược trong hành trình phổ cập Autonomous AI Agent.