Hướng dẫn toàn tập về Self-Hosted Coze Studio – Nền tảng chatbot AI

Trong kỷ nguyên của Trí tuệ Nhân tạo, các mô hình ngôn ngữ lớn (LLM) như GPT-4, Claude 3, và Llama 3 đã mở ra những khả năng phi thường. Chúng ta có thể tạo ra nội dung, phân tích dữ liệu, và tự động hóa các quy trình phức tạp chỉ bằng vài dòng lệnh. Tuy nhiên, khi các nhà phát triển và doanh nghiệp tích hợp sâu hơn các dịch vụ AI này vào hoạt động cốt lõi, một thực tế đáng lo ngại dần hiện ra: chúng ta đang vận hành bên trong những “hộp đen”. Các dịch vụ AI thương mại, dù tiện lợi, thường đi kèm với những lo ngại về quyền riêng tư dữ liệu, chi phí leo thang không thể đoán trước, các giới hạn API cứng nhắc, và quan trọng nhất là sự thiếu khả năng tùy chỉnh sâu vào logic nền tảng.

Dữ liệu độc quyền của công ty, thông tin nhận dạng cá nhân (PII) của khách hàng, hay các thuật toán kinh doanh bí mật đều được gửi đến máy chủ của bên thứ ba để xử lý. Điều này tạo ra một rủi ro tiềm tàng về bảo mật và tuân thủ. Hơn nữa, sự phụ thuộc vào một nhà cung cấp duy nhất (vendor lock-in) có thể kìm hãm sự đổi mới và khiến doanh nghiệp dễ bị tổn thương trước những thay đổi về giá cả hoặc chính sách dịch vụ.

Giữa bối cảnh đó, Coze Studio nổi lên như một nền tảng low-code/no-code đột phá, cho phép bất kỳ ai, từ nhà phát triển chuyên nghiệp đến người dùng không chuyên, có thể xây dựng các AI bot và luồng công việc phức tạp một cách trực quan. Nhưng điểm sáng thực sự, và cũng là trọng tâm của bài viết này, nằm ở sự phân đôi giữa phiên bản Cloud tiện lợi và phiên bản Self-Hosted đầy quyền năng. Phiên bản tự lưu trữ, được cung cấp thông qua bộ công cụ phát triển mã nguồn mở, là câu trả lời cho những thách thức cố hữu của AI dựa trên đám mây.

Sự trỗi dậy của các bộ công cụ phát triển AI mạnh mẽ và có khả năng tự lưu trữ như Coze Studio không chỉ đơn thuần là một danh mục sản phẩm mới; nó là một phản ứng trực tiếp cho một “phong trào chủ quyền” đang lớn mạnh trong cộng đồng công nghệ. Khi các tổ chức ngày càng phụ thuộc vào AI, những rủi ro liên quan đến việc bị khóa chân bởi nhà cung cấp và phơi bày dữ liệu cho các nhà cung cấp LLM bên thứ ba đang trở nên không thể chấp nhận được. Tự lưu trữ đang chuyển mình từ một hoạt động dành cho những người đam mê thích mày mò thành một mệnh lệnh chiến lược cốt lõi cho bất kỳ tổ chức nào xử lý dữ liệu nhạy cảm. Đây là sự tiến hóa tự nhiên, tương tự như cách các doanh nghiệp chuyển từ cơ sở dữ liệu độc quyền sang các hệ thống mã nguồn mở như PostgreSQL, hay từ việc phụ thuộc hoàn toàn vào đám mây công cộng sang các giải pháp đám mây riêng và Kubernetes để giành lại quyền kiểm soát.

Bài viết này là một hướng dẫn toàn diện, được thiết kế để dẫn dắt bạn qua toàn bộ hành trình. Khi đọc xong, bạn sẽ không chỉ thấu hiểu tầm quan trọng chiến lược của việc tự chủ cơ sở hạ tầng AI, mà còn sở hữu một phiên bản Coze Studio hoạt động đầy đủ trên chính máy chủ của mình, sẵn sàng để xây dựng AI bot tùy chỉnh đầu tiên. Hãy cùng nhau khai phá sức mạnh thực sự của AI, theo cách của bạn.

Self-Hosted Coze Studio là gì? So sánh chi tiết với phiên bản Cloud

Trước khi đi sâu vào quá trình cài đặt kỹ thuật, điều quan trọng là phải xây dựng một nền tảng kiến thức vững chắc: Self-hosted Coze Studio chính xác là gì, nó hoạt động như thế nào, và nó khác biệt ra sao so với phiên bản Cloud mà nhiều người đã biết đến.

Tổng quan về Coze Studio

Về cốt lõi, Coze Studio là một môi trường phát triển tích hợp (IDE) trực quan, được thiết kế để đơn giản hóa việc tạo ra các ứng dụng AI thế hệ mới. Thay vì viết hàng ngàn dòng mã, người dùng có thể sử dụng giao diện kéo-thả để xây dựng các luồng công việc (workflows) phức tạp. Các thành phần chính của nền tảng bao gồm:

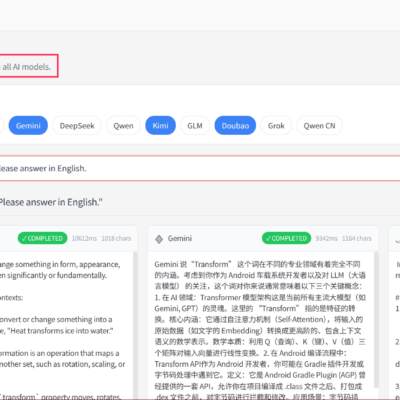

- Tích hợp LLM: Dễ dàng kết nối và chuyển đổi giữa các mô hình ngôn ngữ lớn hàng đầu từ OpenAI, Google, Anthropic, và các nhà cung cấp khác.

- Plugins (Tiện ích mở rộng): Mở rộng khả năng của bot bằng cách tích hợp các công cụ và dịch vụ của bên thứ ba, chẳng hạn như tìm kiếm trên web, đọc tin tức, tạo hình ảnh, hoặc kết nối với các API tùy chỉnh.

- Knowledge Bases (Cơ sở tri thức): Cung cấp cho bot của bạn kiến thức chuyên ngành bằng cách tải lên các tài liệu (PDF, TXT, DOCX). Bot có thể sử dụng kỹ thuật Retrieval-Augmented Generation (RAG) để truy xuất thông tin từ các tài liệu này và đưa ra câu trả lời chính xác, dựa trên ngữ cảnh.

- Cơ sở dữ liệu & Biến: Lưu trữ và truy xuất thông tin một cách bền bỉ, cho phép bot ghi nhớ các cuộc trò chuyện trước đó hoặc lưu trữ dữ liệu có cấu trúc.

Sự khác biệt của phiên bản tự lưu trữ (Self-Hosted)

Phiên bản tự lưu trữ, được phân phối qua kho mã nguồn Coze Studio GitHub, cung cấp toàn bộ bộ máy (engine) và giao diện cốt lõi của Coze Studio. Tuy nhiên, thay vì chạy trên cơ sở hạ tầng của Coze, nó được đóng gói dưới dạng các container Docker để bạn có thể triển khai trên bất kỳ máy chủ nào bạn kiểm soát – dù đó là một máy chủ ảo (VPS) giá rẻ, một máy chủ chuyên dụng mạnh mẽ, hay thậm chí là cơ sở hạ tầng tại chỗ (on-premise) của doanh nghiệp bạn.

Về mặt kiến trúc, khi bạn khởi chạy nó bằng Docker, một loạt các dịch vụ sẽ được triển khai. Các thành phần chính bao gồm dịch vụ ứng dụng web cung cấp giao diện người dùng, một cơ sở dữ liệu (thường là một hệ thống file-based hoặc một database container) để quản lý trạng thái, lưu trữ định nghĩa bot, luồng công việc, và các cấu hình khác. Mô hình này mang lại cho bạn một bản sao riêng biệt, hoàn toàn độc lập của nền tảng Coze.

Để giúp bạn đưa ra quyết định sáng suốt, bảng so sánh chi tiết dưới đây sẽ làm rõ những ưu và nhược điểm của hai phiên bản. Việc phân tích này không chỉ là một bài tập kỹ thuật; nó là một quá trình đánh giá chi phí-lợi ích. “Chi phí” của việc tự lưu trữ là công sức bảo trì, sự phức tạp trong cài đặt ban đầu và chi phí hạ tầng. “Lợi ích” là quyền riêng tư, khả năng tùy chỉnh vô hạn và quyền kiểm soát tuyệt đối. Bảng này trình bày các yếu tố đối lập đó một cách trực quan, giúp bạn nhanh chóng nắm bắt được các đánh đổi cơ bản.

Bảng so sánh: Coze Studio – Self-Hosted vs. Cloud Version

| Feature / Tiêu chí | Self-Hosted Version (Tự Lưu Trữ) | Cloud Version (Bản Cloud) |

|---|---|---|

| Data Privacy & Security (Bảo mật & Quyền riêng tư dữ liệu) | Kiểm soát tối đa: Toàn bộ dữ liệu, prompt và kết quả đầu ra đều nằm trên máy chủ của bạn. Lý tưởng cho thông tin nhạy cảm hoặc độc quyền. | Nền tảng quản lý: Dữ liệu được xử lý trên máy chủ của Coze. Phụ thuộc vào chính sách bảo mật và điều khoản dịch vụ của họ. |

| Customization & Extensibility (Tùy chỉnh & Mở rộng) | Không giới hạn: Khả năng phát triển và tích hợp các plugin tùy chỉnh, kết nối với bất kỳ cơ sở dữ liệu/API nội bộ nào, và có khả năng sửa đổi mã nguồn. | Giới hạn: Bị giới hạn trong các plugin và tích hợp có sẵn trên thị trường của Coze. |

| Cost Model (Mô hình chi phí) | Dựa trên hạ tầng: Bạn trả tiền cho máy chủ của mình (VPS, dedicated, on-prem). Chi phí gọi API LLM được thanh toán trực tiếp cho nhà cung cấp (ví dụ: OpenAI, Anthropic). | Có thể là Freemium/Đăng ký: Thường có gói miễn phí với các giới hạn, sau đó là các gói trả phí. Chi phí LLM có thể được gộp chung hoặc bị tính thêm phí. |

| Scalability (Khả năng mở rộng) | Tự quản lý: Bạn chịu trách nhiệm mở rộng tài nguyên máy chủ (CPU, RAM, lưu trữ) khi lượng sử dụng tăng lên. | Nền tảng quản lý: Coze tự động xử lý việc mở rộng hạ tầng cơ bản. |

| Maintenance & Updates (Bảo trì & Cập nhật) | Thủ công: Bạn phải tự lấy các bản cập nhật từ kho GitHub và quản lý quy trình triển khai. | Tự động: Nền tảng luôn được cập nhật với các tính năng và bản vá bảo mật mới nhất. |

| Feature Availability (Tính năng sẵn có) | Khung sườn cốt lõi: Cung cấp bộ máy thiết yếu để tạo bot. Có thể thiếu một số tính năng độc quyền, được trau chuốt của phiên bản cloud. | Bộ tính năng đầy đủ: Bao gồm tất cả các cải tiến UI/UX mới nhất, các tích hợp được xây dựng sẵn và các công cụ độc quyền. |

Tóm lại, việc lựa chọn giữa phiên bản tự lưu trữ và phiên bản cloud là một sự đánh đổi giữa quyền kiểm soát và sự tiện lợi. Nếu bạn ưu tiên tốc độ, sự đơn giản và không xử lý dữ liệu quá nhạy cảm, phiên bản cloud là một lựa chọn tuyệt vời. Nhưng nếu bạn là một nhà phát triển, một doanh nghiệp coi trọng chủ quyền dữ liệu, hoặc một người đam mê muốn phá vỡ mọi giới hạn, thì phiên bản tự lưu trữ chính là con đường bạn cần đi.

Hướng dẫn cài đặt Self-Hosted Coze Studio chi tiết

Đây là phần cốt lõi của bài viết, nơi chúng ta sẽ biến lý thuyết thành hiện thực. Quá trình cài đặt Coze Studio tự lưu trữ sử dụng Docker và Docker Compose, giúp chuẩn hóa môi trường và đơn giản hóa việc triển khai trên hầu hết các hệ điều hành Linux hiện đại. Hướng dẫn này được viết cho Ubuntu 22.04 LTS, nhưng các lệnh có thể dễ dàng điều chỉnh cho các bản phân phối khác như CentOS hoặc Debian.

Yêu cầu hệ thống và các thành phần phụ thuộc

Trước khi bắt đầu, điều quan trọng là phải đảm bảo máy chủ của bạn đáp ứng các yêu cầu tối thiểu. Việc kiểm tra trước sẽ giúp bạn tránh được những lỗi không đáng có trong quá trình cài đặt.

| Component | Minimum Requirement (Yêu cầu tối thiểu) | Recommended (Khuyến nghị) | Notes (Ghi chú) |

|---|---|---|---|

| Operating System | Linux (Ubuntu 20.04+, CentOS 7+) | Ubuntu 22.04 LTS | Tương thích với hầu hết các bản phân phối Linux hiện đại. |

| CPU | 2 vCPU | 4 vCPU | Nhiều nhân hơn giúp giao diện người dùng và việc thực thi luồng công việc phản hồi nhanh hơn. |

| RAM | 4 GB | 8 GB | Rất quan trọng để chạy nhiều container một cách mượt mà. |

| Storage | 20 GB SSD | 50 GB SSD | SSD được khuyến nghị mạnh mẽ để tăng hiệu suất cơ sở dữ liệu. |

| Software | Git, Docker (v20.10+), Docker Compose (v2.0+) | Phiên bản ổn định mới nhất | Đảm bảo Docker đang chạy và người dùng có quyền sudo. |

Bước 1: Chuẩn bị Môi trường (Preparing the Environment)

Bước đầu tiên là cập nhật hệ thống của bạn và cài đặt các công cụ cần thiết: Git, Docker, và Docker Compose.

Mở terminal trên máy chủ của bạn và chạy các lệnh sau:

1. Cập nhật danh sách gói và nâng cấp hệ thống:

sudo apt update && sudo apt upgrade -yLệnh này đảm bảo rằng bạn đang làm việc với các phiên bản phần mềm mới nhất và an toàn nhất.

2. Cài đặt Git, Docker và Docker Compose:

sudo apt install git docker.io docker-compose -y- Git: Cần thiết để sao chép (clone) mã nguồn từ kho lưu trữ GitHub.

- Docker (docker.io): Là nền tảng container hóa, cho phép chúng ta chạy ứng dụng Coze Studio trong một môi trường bị cô lập.

- Docker Compose: Là một công cụ để định nghĩa và chạy các ứng dụng Docker đa container. Nó đọc một tệp YAML để cấu hình các dịch vụ của ứng dụng.

3. (Tùy chọn nhưng khuyến nghị) Thêm người dùng vào nhóm Docker:

Để tránh phải gõ sudo trước mỗi lệnh docker, hãy thêm người dùng hiện tại của bạn vào nhóm docker.

sudo usermod -aG docker $USERSau khi chạy lệnh này, bạn cần đăng xuất và đăng nhập lại để thay đổi có hiệu lực.

Bước 2: Tải mã nguồn từ Coze Studio GitHub (Cloning the Source Code)

Bây giờ, chúng ta sẽ tải xuống bộ công cụ phát triển từ kho lưu trữ chính thức trên GitHub. Đây là bước quan trọng nhắm đến từ khóa “Coze Studio GitHub“.

1. Sao chép kho lưu trữ:

git clone https://github.com/coze-dev/coze-studio.gitLệnh này sẽ tạo một thư mục mới có tên là coze-studio trong thư mục hiện tại của bạn và tải xuống toàn bộ mã nguồn, bao gồm cả tệp cấu hình quan trọng docker-compose.yml.

2. Di chuyển vào thư mục dự án:

cd coze-studioTất cả các lệnh tiếp theo sẽ được thực hiện từ bên trong thư mục này.

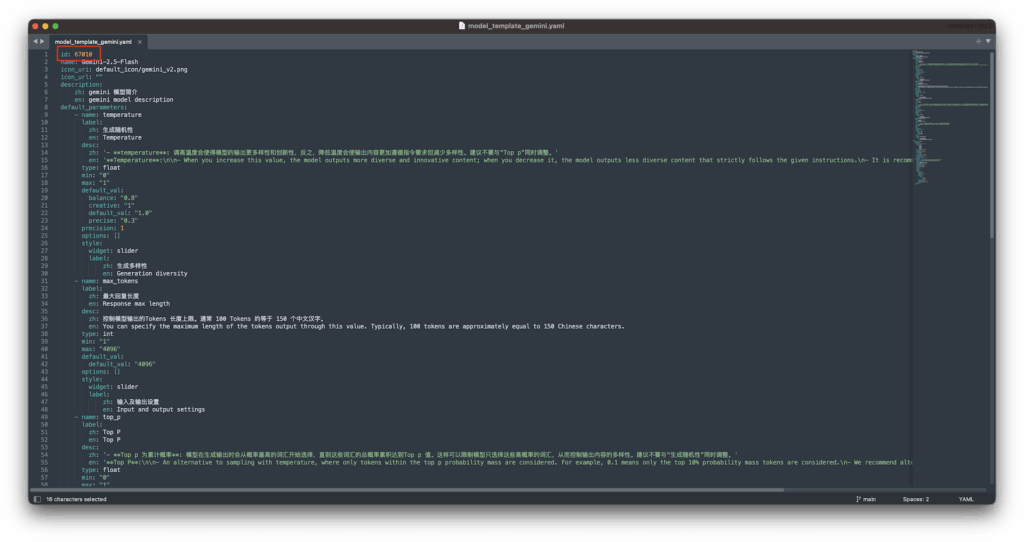

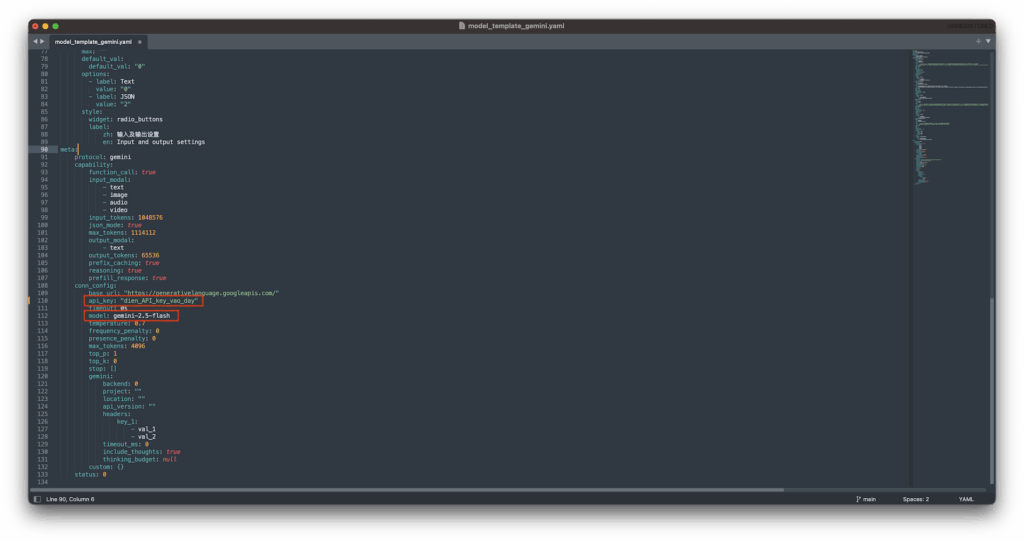

3. Sao chép các tệp mẫu của mô hình doubao-seed-1.6 từ thư mục mẫu và dán chúng vào thư mục tệp cấu hình.

cp backend/conf/model/template/model_template_gemini.yaml backend/conf/model/model_template_gemini.yaml4. Sửa đổi tệp mẫu trong thư mục tệp cấu hình.

- Vào thư mục

backend/conf/model. Mở tệpmodel_template_gemini.yaml. - Đặt các trường

id,meta.conn_config.api_key,meta.conn_config.model, và lưu tệp.- id : ID mô hình trong Coze Studio, do nhà phát triển định nghĩa, phải là một số nguyên khác không và duy nhất trên toàn cục. Các tác nhân hoặc quy trình công việc gọi mô hình dựa trên ID mô hình. Đối với các mô hình đã được khởi chạy, không sửa đổi ID của chúng; nếu không, có thể dẫn đến lỗi gọi mô hình.

- meta.conn_config.api_key : Khóa API thì bạn vào https://aistudio.google.com/api-keys tạo và điền vào đây

- meta.conn_config.model: Để mặc định là

gemini-2.5-flash

Hoặc bạn có thể dùng các model AI khác, xem các file template trong thư mục backend/conf/model/template/, rồi copy ra backend/conf/model/ để edit bổ sung các thông tin như trên.

LƯU Ý:

Nếu sau này muốn đổi thông tin thì sau khi đổi xong cần chạy lệnh này để khởi động lại container:

docker compose --profile "*" restart coze-serverBước 3: Cấu hình biến môi trường (Configuring Environment Variables)

Đây là bước quan trọng nhất và đòi hỏi sự chú ý cẩn thận. Chúng ta cần tạo một tệp .env để lưu trữ các cấu hình nhạy cảm như API key và đường dẫn tệp.

1. Tạo tệp .env từ tệp mẫu:

Dự án cung cấp một tệp mẫu có tên là .env.example. Chúng ta sẽ sao chép nó để tạo tệp cấu hình của riêng mình.

cd docker

cp .env.example .envBước 4: Khởi chạy với Docker Compose (Launching with Docker Compose)

Với mọi thứ đã được cấu hình, giờ là lúc khởi chạy ứng dụng.

1. Chạy Docker Compose:

docker-compose up -dHãy phân tích lệnh này:

docker-compose up: Đọc tệpdocker-compose.yml, tải xuống các image container cần thiết (nếu chúng chưa có trên máy của bạn), sau đó tạo và khởi động các container.-d: Viết tắt của “detached mode”. Tùy chọn này chạy các container ở chế độ nền, vì vậy bạn có thể đóng terminal mà không làm dừng ứng dụng.

Lần đầu tiên chạy, quá trình này có thể mất vài phút vì Docker cần tải xuống các image. Các lần sau sẽ nhanh hơn nhiều.

2. Kiểm tra trạng thái container:

Để xác nhận rằng mọi thứ đang chạy đúng cách, bạn có thể sử dụng lệnh:

docker-compose psBạn sẽ thấy một danh sách các container đang chạy với trạng thái “Up” hoặc “Running”.

Bước 5: Truy cập và hoàn tất cài đặt (Accessing and Finalizing the Setup)

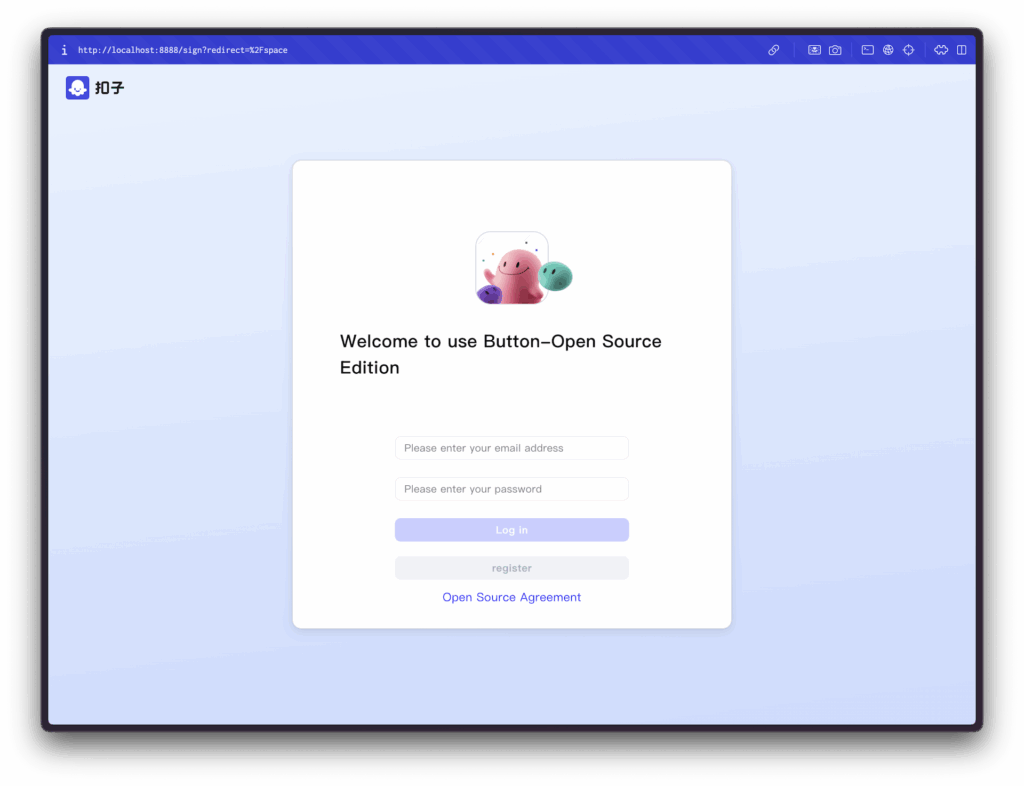

1. Truy cập giao diện web:

Mở trình duyệt web của bạn và điều hướng đến địa chỉ sau, thay <your_server_ip> bằng địa chỉ IP công khai của máy chủ của bạn: http://<your_server_ip>:8888

Nếu bạn cài đặt trên máy của bạn thì truy cập vào localhost:8888

2. Tạo tài khoản quản trị:

Lần đầu tiên truy cập, Coze Studio sẽ yêu cầu bạn tạo một tài khoản quản trị. Hãy điền thông tin và tạo tài khoản của bạn.

Chúc mừng! Bạn đã cài đặt thành công self-hosted Coze Studio trên máy chủ của riêng mình.

Xử lý sự cố thường gặp (Common Troubleshooting)

- Vấn đề: Lỗi “Port is already allocated” (Cổng đã được sử dụng).

- Nguyên nhân: Một dịch vụ khác trên máy chủ của bạn đang sử dụng cổng 8888.

- Giải pháp: Kiểm tra xem dịch vụ nào đang sử dụng cổng bằng lệnh

sudo lsof -i:8888. Sau đó, bạn có thể dừng dịch vụ đó hoặc thay đổi cổng mà Coze sử dụng bằng cách chỉnh sửa tệp docker-compose.yml. Tìm dòngports: - "8888:8888"và thay đổi cổng đầu tiên (ví dụ: “8889:8888”). Sau đó, truy cập bằng cổng mới. - Vấn đề: Lỗi “Permission denied” khi chạy lệnh docker.

- Nguyên nhân: Người dùng của bạn không có quyền truy cập vào Docker daemon.

- Giải pháp: Chạy lệnh với sudo (ví dụ:

sudo docker-compose up -d) hoặc thêm người dùng của bạn vào nhóm docker như đã hướng dẫn ở Bước 1 và đăng xuất/đăng nhập lại. - Vấn đề: Các container liên tục khởi động lại (Restarting).

- Nguyên nhân: Đây thường là dấu hiệu của một lỗi cấu hình, phổ biến nhất là API key bị thiếu hoặc không hợp lệ trong tệp .env.

- Giải pháp: Xem nhật ký của các container để tìm ra nguyên nhân gốc rễ. Chạy lệnh

docker-compose logs -fđể xem luồng nhật ký trực tiếp. Tìm các thông báo lỗi, chúng thường sẽ cho bạn biết biến môi trường nào bị thiếu hoặc sai.

Khám phá giao diện và xây dựng AI bot đầu tiên của bạn

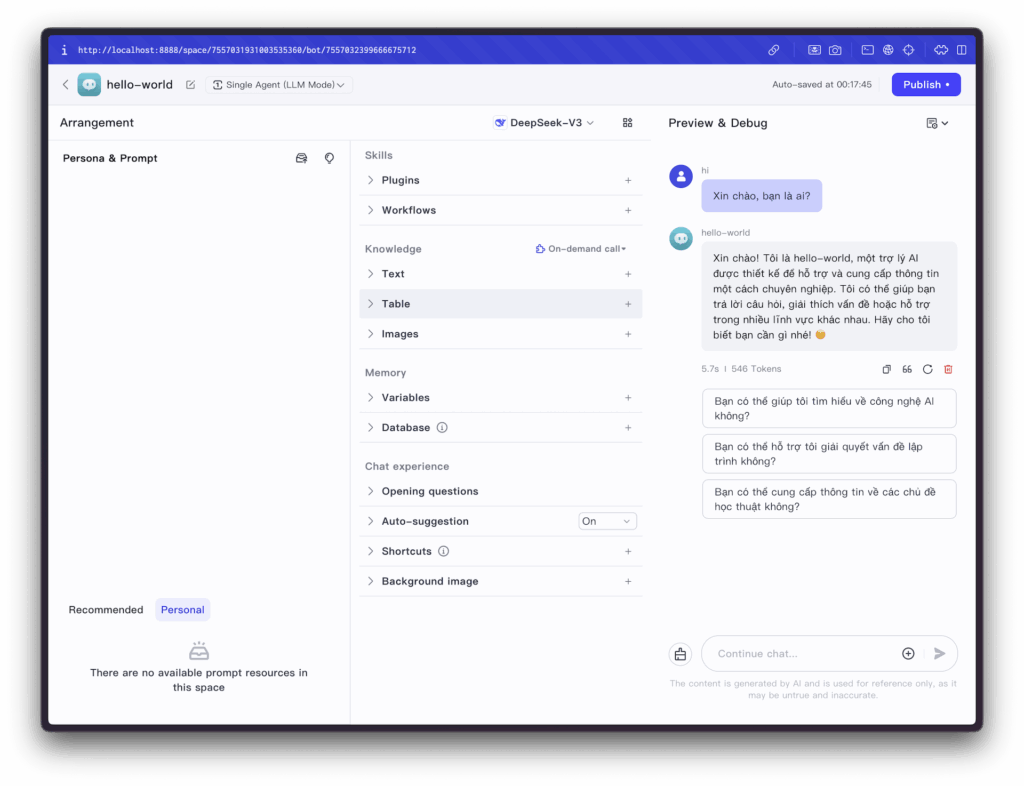

Sau khi hoàn thành quá trình cài đặt kỹ thuật, bước tiếp theo là trải nghiệm thành quả ngay lập tức. Phần này sẽ cung cấp cho bạn một “chiến thắng” nhanh chóng bằng cách hướng dẫn bạn qua giao diện người dùng và giúp bạn xây dựng một AI bot đơn giản. Điều này không chỉ xác nhận rằng toàn bộ hệ thống của bạn đang hoạt động chính xác mà còn xây dựng sự tự tin để bạn tiếp tục khám phá các tính năng mạnh mẽ hơn.

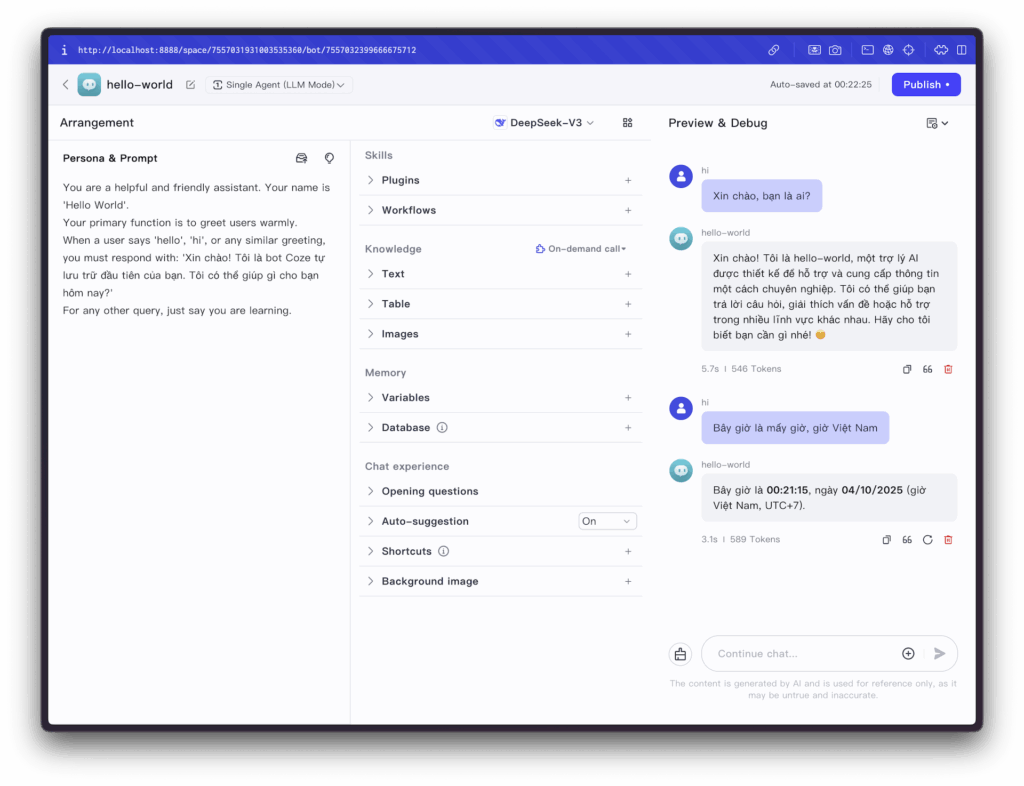

Tour Tham Quan Giao Diện Chính

Khi đăng nhập lần đầu, bạn sẽ được chào đón bởi một giao diện sạch sẽ và có tổ chức. Hãy dành một chút thời gian để làm quen với các khu vực chính (sử dụng các ảnh chụp màn hình để minh họa sẽ rất hữu ích ở đây):

- Bảng điều khiển Bot (Bots Dashboard): Đây là trang chủ của bạn, nơi hiển thị tất cả các bot bạn đã tạo. Từ đây, bạn có thể tạo bot mới, chỉnh sửa bot hiện có, hoặc xóa chúng.

- Trình chỉnh sửa Bot (Bot Editor): Khi bạn nhấp vào một bot, bạn sẽ vào khu vực làm việc chính. Khu vực này được chia thành nhiều tab:

- Persona & Prompt: Nơi bạn định nghĩa danh tính, tính cách và chỉ dẫn hệ thống (system prompt) cho bot của mình. Đây là “bộ não” của bot.

- Skills (Kỹ năng): Đây là nơi bạn thêm các Plugin, Knowledge Base và Workflows để mở rộng khả năng của bot.

- Trình chỉnh sửa Luồng công việc (Workflow Editor): Đây là trái tim của Coze Studio. Một giao diện trực quan dựa trên node cho phép bạn thiết kế các logic phức tạp. Bạn có thể kéo-thả các node như “Start”, “LLM”, “Code”, “Knowledge Base Search” và kết nối chúng lại với nhau để tạo ra một quy trình xử lý tự động.

- Cơ sở tri thức (Knowledge Bases): Khu vực để bạn tải lên và quản lý các tài liệu của mình. Coze sẽ tự động xử lý, phân đoạn và lập chỉ mục các tài liệu này để bot có thể tìm kiếm thông tin một cách hiệu quả.

- Plugin: Nơi bạn có thể kích hoạt các plugin tích hợp sẵn (như công cụ tìm kiếm Google) hoặc tạo ra các plugin tùy chỉnh của riêng mình để kết nối với các API bên ngoài.

Hướng dẫn xây dựng bot “Hello world”

Hãy cùng nhau tạo một bot đơn giản để xác nhận mọi thứ hoạt động. Bot này sẽ được lập trình để đáp lại lời chào một cách thân thiện.

Bước 1: Tạo một Bot mới

- Trên Bảng điều khiển Bot, nhấp vào nút “Create bot”.

- Đặt tên cho bot của bạn, ví dụ: “Hello World”.

- Viết một mô tả ngắn gọn, ví dụ: “Một bot được tạo để chào hỏi người dùng”.

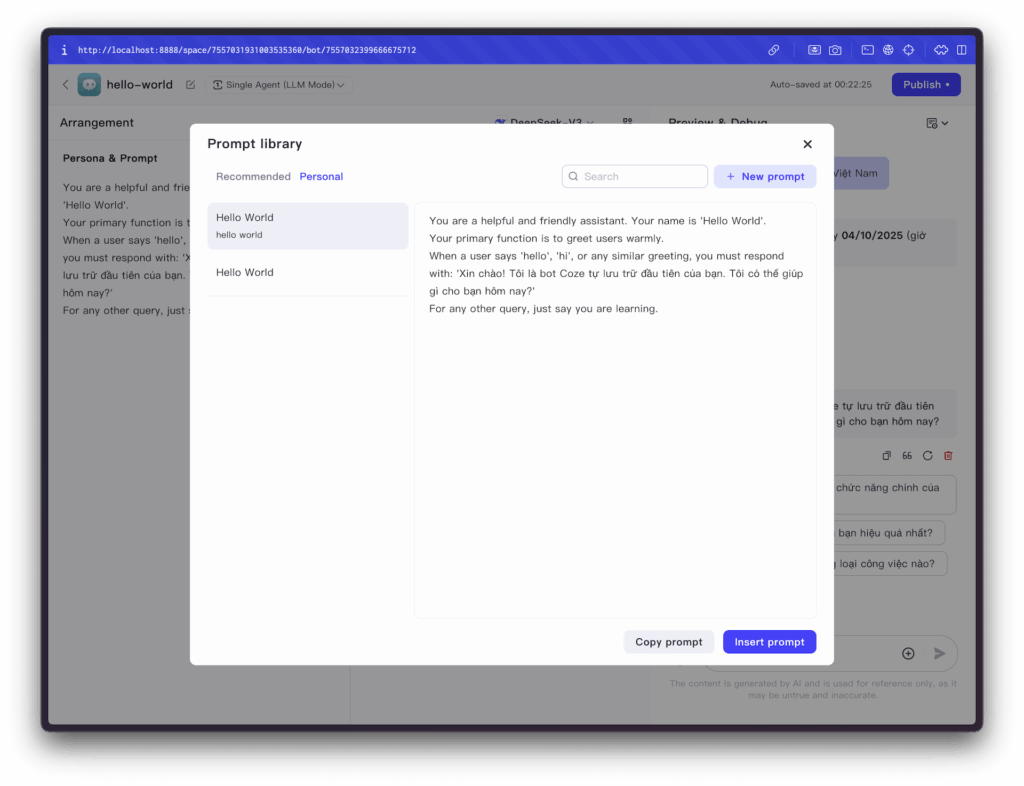

Bước 2: Định nghĩa Persona

- Trong tab “Persona & Prompt”, bạn sẽ thấy một ô văn bản lớn. Đây là nơi bạn đưa ra chỉ dẫn cho LLM.

- Nhập vào nội dung sau:

You are a helpful and friendly assistant. Your name is ‘Hello World’.

Your primary function is to greet users warmly.

When a user says ‘hello’, ‘hi’, or any similar greeting, you must respond with: ‘Xin chào! Tôi là bot Coze tự lưu trữ đầu tiên của bạn. Tôi có thể giúp gì cho bạn hôm nay?’

For any other query, just say you are learning. - Nhấp vào “Optimize” để Coze tinh chỉnh prompt của bạn, sau đó lưu lại.

Bước 3: Thử nghiệm Bot

- Ở phía bên phải của màn hình, bạn sẽ thấy một bảng điều khiển “Debug & Preview”. Đây là nơi bạn có thể trò chuyện với bot của mình ngay lập tức.

- Trong ô nhập liệu, gõ hello và nhấn Enter.

- Kết quả mong đợi: Bot sẽ trả lời chính xác câu: “Xin chào! Tôi là bot Coze tự lưu trữ đầu tiên của bạn. Tôi có thể giúp gì cho bạn hôm nay?”.

- Thử gõ một câu khác, ví dụ: “Bây giờ là mấy giờ”. Bot sẽ trả lời rằng nó đang học, đúng như chúng ta đã chỉ dẫn trong prompt.

Chỉ với vài bước đơn giản, bạn đã tạo và tương tác thành công với AI bot đầu tiên trên nền tảng tự lưu trữ của mình. Điều này chứng tỏ rằng kết nối đến LLM (thông qua API key bạn đã cung cấp) đang hoạt động, và bộ máy xử lý của Coze đã được cài đặt chính xác. Giờ đây, bạn đã sẵn sàng để khám phá những ứng dụng phức tạp và giá trị hơn nhiều.

Ứng dụng nâng cao và các trường hợp sử dụng thực tế

Sau khi đã làm chủ những điều cơ bản, đã đến lúc khám phá tiềm năng thực sự của nền tảng Coze Studio tự lưu trữ của bạn. Sức mạnh của nó không nằm ở việc tạo ra các bot trò chuyện đơn giản, mà ở khả năng xây dựng các ứng dụng AI phức tạp, tích hợp sâu vào quy trình làm việc và giải quyết các vấn đề kinh doanh thực tế. Phần này sẽ truyền cảm hứng cho bạn bằng cách trình bày chi tiết ba trường hợp sử dụng nâng cao, có giá trị cao.

1. Xây dựng bot hỗ trợ nội bộ cho doanh nghiệp (Internal Corporate Helpdesk Bot)

Ý tưởng: Một trợ lý AI luôn sẵn sàng 24/7 để trả lời các câu hỏi của nhân viên về chính sách nhân sự, hướng dẫn khắc phục sự cố CNTT, quy trình làm việc của công ty, và nhiều hơn nữa. Điều này giúp giảm tải cho các bộ phận hỗ trợ và cung cấp câu trả lời tức thì cho nhân viên.

Cách thực hiện:

Bước 1: Tạo cơ sở tri thức (Knowledge Base):

- Thu thập tất cả các tài liệu liên quan: sổ tay nhân viên (PDF), hướng dẫn khắc phục sự cố máy tính (Word), chính sách nghỉ phép, quy trình báo cáo chi phí, v.v.

- Trong Coze Studio, tạo một Knowledge Base mới có tên là “Tri thức nội bộ doanh nghiệp”.

- Tải lên tất cả các tài liệu đã thu thập. Coze sẽ tự động xử lý và chuẩn bị chúng cho việc truy vấn.

Bước 2: Thiết kế luồng công việc (Workflow):

- Tạo một workflow mới. Bắt đầu với node Start.

- Kết nối node Start với một node Knowledge Base Retrieval. Cấu hình node này để tìm kiếm trong “Tri thức Nội bộ Doanh nghiệp” dựa trên câu hỏi của người dùng.

- Sử dụng một node If/Else để kiểm tra xem Knowledge Base có tìm thấy kết quả phù hợp hay không.

- Nhánh “Có kết quả”: Kết nối với một node LLM. Trong prompt của node này, hãy chỉ dẫn: “Dựa vào thông tin được cung cấp sau đây, hãy trả lời câu hỏi của người dùng một cách rõ ràng và chuyên nghiệp.”

- Nhánh “Không có kết quả”: Đây là phần thú vị. Kết nối với một node Plugin. Plugin này có thể là một plugin tùy chỉnh bạn tự viết để:

- Tạo một ticket mới trong hệ thống quản lý dịch vụ như Jira hoặc ServiceNow.

- Gửi một email đến bộ phận hỗ trợ nhân sự hoặc CNTT với nội dung câu hỏi của người dùng.

- Kết thúc cả hai nhánh bằng node End.

Giá trị mang lại: Ứng dụng này thể hiện sức mạnh của Retrieval-Augmented Generation (RAG) trong một môi trường an toàn. Toàn bộ tài liệu nội bộ nhạy cảm của công ty không bao giờ rời khỏi máy chủ của bạn. Bot không chỉ cung cấp thông tin mà còn tự động hóa quy trình khi nó không thể tự giải quyết, tạo ra một hệ thống hỗ trợ liền mạch và hiệu quả.

2. Tạo công cụ tóm tắt và phân tích tài liệu tự động

Ý tưởng: Một công cụ mạnh mẽ dành cho các nhà phân tích, nhà nghiên cứu hoặc luật sư. Người dùng có thể tải lên một tài liệu dài (báo cáo tài chính, bài báo khoa học, hồ sơ pháp lý) và nhận lại một bản tóm tắt súc tích, danh sách các thực thể chính (tên người, tổ chức, ngày tháng), và phân tích cảm xúc tổng thể.

Cách thực hiện:

Bước 1: Thiết kế Lu-ồng công việc:

- Bắt đầu với một node Start chấp nhận một khối văn bản lớn làm đầu vào.

- Kết nối với một node LLM đầu tiên. Cấu hình prompt của nó để thực hiện nhiệm vụ tóm tắt. Ví dụ: “Tóm tắt văn bản sau thành 3 gạch đầu dòng chính, tập trung vào các kết luận quan trọng nhất.”

- Thêm một node LLM thứ hai song song. Cấu hình prompt của nó để trích xuất thực thể: “Từ văn bản sau, trích xuất tất cả tên người, tên tổ chức, và ngày tháng. Trả về kết quả dưới dạng JSON.”

- Thêm một node LLM thứ ba. Cấu hình prompt để phân tích cảm xúc: “Phân tích cảm xúc tổng thể của văn bản sau. Trả lời chỉ bằng một trong ba từ: Tích cực, Tiêu cực, hoặc Trung tính.”

Bước 2: Lưu trữ kết quả:

- Kết nối đầu ra của cả ba node LLM với một node Plugin tùy chỉnh.

- Plugin này có thể được lập trình để kết nối với một cơ sở dữ liệu (ví dụ: PostgreSQL, MySQL) đang chạy trên cùng máy chủ hoặc trong mạng nội bộ của bạn.

- Plugin sẽ nhận dữ liệu (bản tóm tắt, JSON thực thể, cảm xúc) và ghi nó vào một bảng trong cơ sở dữ liệu để lưu trữ và phân tích sau này.

Giá trị mang lại: Ứng dụng này biến LLM từ một công cụ trò chuyện thành một cỗ máy xử lý dữ liệu có cấu trúc. Bằng cách tự lưu trữ, bạn có thể xử lý các tài liệu nhạy cảm mà không lo ngại về quyền riêng tư. Khả năng kết nối trực tiếp với cơ sở dữ liệu nội bộ mở ra vô số khả năng cho việc xây dựng các bảng điều khiển phân tích và báo cáo tự động.

3. Phát triển Trợ lý AI Cá nhân hóa

Ý tưởng: Đây là đỉnh cao của việc tự lưu trữ – tạo ra một trợ lý AI thực sự của riêng bạn, được tích hợp sâu vào cuộc sống số cá nhân của bạn. Một trợ lý có thể truy cập lịch, quản lý danh sách công việc, và tương tác với các dịch vụ cá nhân khác của bạn.

Cách thực hiện:

Bước 1: Tạo Plugin Tùy chỉnh:

- Plugin Lịch (Calendar Plugin): Viết một plugin nhỏ (ví dụ, bằng Python với Flask) có chức năng kết nối với API Lịch Google hoặc Microsoft Outlook của bạn. Tạo các điểm cuối (endpoints) cho các hành động như get_todays_events (lấy sự kiện hôm nay) và create_event (tạo sự kiện mới).

- Plugin Công việc (To-Do Plugin): Tương tự, tạo một plugin khác kết nối với API của ứng dụng quản lý công việc bạn yêu thích (Todoist, Asana, etc.) với các chức năng như add_task (thêm công việc) và list_due_tasks (liệt kê công việc sắp hết hạn).

Bước 2: Tích hợp vào Coze Studio:

- Trong phần Plugins của Coze, tạo các công cụ mới tương ứng với các plugin bạn vừa viết. Cung cấp URL của các endpoint và mô tả rõ ràng về chức năng của chúng để LLM có thể hiểu và sử dụng.

- Ví dụ, mô tả cho add_task có thể là: “Sử dụng công cụ này để thêm một công việc mới vào danh sách việc cần làm của người dùng. Yêu cầu đầu vào là nội dung của công việc.”

Bước 3: Tương tác:

- Bây giờ, bạn có thể kích hoạt các plugin này trong bot của mình và bắt đầu ra lệnh bằng ngôn ngữ tự nhiên:

- “Hôm nay tôi có cuộc họp nào không?” -> Bot sẽ gọi plugin Lịch.

- “Thêm ‘hoàn thành bài blog về Coze’ vào danh sách công việc của tôi.” -> Bot sẽ gọi plugin Công việc.

Giá trị mang lại: Trường hợp sử dụng này thể hiện lời hứa cuối cùng của việc tự lưu trữ: tạo ra một AI thực sự riêng tư và được cá nhân hóa. Trợ lý này hoạt động dựa trên dữ liệu cá nhân của bạn, cho các nhu cầu cụ thể của bạn, mà không bao giờ gửi bất kỳ thông tin nhạy cảm nào (như quyền truy cập vào lịch hoặc danh sách công việc) cho bất kỳ bên thứ ba nào. Bạn đang xây dựng một bộ não thứ hai, hoàn toàn nằm trong tầm kiểm soát của mình.

Tương lai của Self-Hosted Coze Studio và sức mạnh cộng đồng

Bạn đã hoàn thành một hành trình đáng kể: từ việc hiểu rõ các khái niệm chiến lược đằng sau việc tự lưu trữ, vượt qua các thách thức kỹ thuật của việc cài đặt, cho đến việc xây dựng AI bot đầu tiên và hình dung ra các ứng dụng nâng cao. Giờ đây, bạn không chỉ là người dùng một công cụ AI; bạn là người vận hành, người kiểm soát và là kiến trúc sư cho hệ sinh thái AI của riêng mình. Nhưng hành trình này không kết thúc ở đây.

Nền tảng của phiên bản tự lưu trữ chính là kho mã nguồn mở Coze Studio GitHub. Đây không chỉ là nơi để bạn tải xuống mã nguồn; nó là trung tâm của một cộng đồng các nhà phát triển, những người đam mê và những người đổi mới đang cùng nhau định hình tương lai của nền tảng. Tầm quan trọng của cộng đồng này không thể bị xem nhẹ.

- Luôn Cập nhật: Thế giới AI phát triển với tốc độ chóng mặt. Bằng cách theo dõi (watching) và đánh dấu sao (starring) kho lưu trữ GitHub, bạn sẽ là người đầu tiên biết về các tính năng mới, các bản vá lỗi quan trọng và các cải tiến về hiệu suất. Việc thường xuyên chạy lệnh git pull và docker-compose up -d –build sẽ đảm bảo nền tảng của bạn luôn được cập nhật.

- Báo cáo Lỗi và Đóng góp: Nếu bạn gặp phải một vấn đề, mục “Issues” trên GitHub là nơi tốt nhất để báo cáo nó. Bằng cách cung cấp các báo cáo lỗi chi tiết, bạn không chỉ giúp chính mình mà còn giúp toàn bộ cộng đồng. Nếu bạn có kỹ năng, bạn thậm chí có thể đóng góp các bản sửa lỗi hoặc các tính năng mới thông qua các “pull request”.

- Hệ sinh thái Plugin Cộng đồng: Tương lai của Coze Studio tự lưu trữ sẽ được thúc đẩy mạnh mẽ bởi các plugin do cộng đồng phát triển. Hãy tưởng tượng một thị trường các plugin mã nguồn mở để kết nối với mọi thứ, từ các thiết bị nhà thông minh, các nền tảng giao dịch tài chính, cho đến các công cụ khoa học dữ liệu. Bằng cách tham gia, bạn có thể là một phần của sự phát triển đó.

Nhìn về phía trước, chúng ta có thể dự đoán rằng lộ trình phát triển của Coze Studio sẽ tập trung vào việc mở rộng hỗ trợ cho nhiều mô hình ngôn ngữ lớn hơn, cung cấp các công cụ gỡ lỗi tinh vi hơn, và có lẽ là cả các tính năng nâng cao để quản lý nhiều bot trong môi trường doanh nghiệp. Sức mạnh thực sự nằm ở việc nền tảng này cung cấp một khung sườn vững chắc, để lại không gian vô hạn cho sự sáng tạo của bạn và cộng đồng.

Bạn đã cài đặt thành công Coze Studio và xây dựng bot đầu tiên của mình. Bạn đã nắm trong tay các công cụ để tạo ra các ứng dụng AI an toàn, tùy chỉnh và mạnh mẽ. Bạn hiện đang hoàn toàn kiểm soát vận mệnh AI của mình. Câu hỏi bây giờ không còn là “làm thế nào”, mà là “cái gì”. Bạn sẽ xây dựng gì tiếp theo?